안녕하세요! 오늘은 Meta에서 공개한 최신 오픈소스 대규모 언어 모델(LLM)인 Llama 3.2에 대해 알아보겠습니다. Llama 3.2는 이전 3.1 버전보다 향상된 성능을 보여주며, 특히 에지(Edge) 컴퓨팅 및 비전 분야에서 큰 혁신을 일으키고 있습니다. 이 모델은 텍스트 생성부터 이미지 추론에 이르기까지 다양한 작업을 수행할 수 있으며, 경량화된 모델을 통해 Edge 기기에서도 효율적으로 사용할 수 있다는 점이 주목할 만합니다. 이번 블로그에서는 Llama 3.2의 주요 특징과 모델 종류, 벤치마크 결과, 그리고 다양한 테스트를 통해 그 성능을 분석해 보도록 하겠습니다.

"이 포스팅은 쿠팡 파트너스 활동의 일환으로, 이에 따른 일정액의 수수료를 제공받습니다."

Llama 3.2 개요 및 특징

Llama 3.2는 1B, 3B, 11B 및 90B의 다양한 크기로 제공되어 다양한 배포 요구 사항과 장치 기능을 충족합니다. 1B 및 3B 모델은 텍스트 전용 모델로 최대 128,000개의 토큰의 컨텍스트 길이를 지원하며, 11B 및 90B 모델은 텍스트와 이미지 입력을 모두 허용하여 이미지 인식, 캡션 생성 및 시각적 질문 답변과 같은 애플리케이션을 가능하게 합니다.

| 모델크기 | 용도 | 설명 | 입력 | 출력 |

| 1B, 3B | 텍스트전용 | 가볍고 효율적인 모델, 모바일 및 에지 장치에서 실행 가능 | 다국어 텍스트 | 다국어 텍스트 및 코드 |

| 11B, 90B | 멀티모달 | 유연하고 고해상도 이미지를 추론할 수 있는 개방형 멀티모달 모델 | 텍스트 + 이미지 (영어) |

텍스트 |

Llama 3.2

The open source AI model you can fine-tune, distill and deploy anywhere. Our latest models are available in 8B, 70B, and 405B variants.

www.llama.com

1. 경량 텍스트 모델 : 1B, 3B

Llama 3.2 1B 및 3B 모델은 모바일 및 에지 장치에서 실행되도록 최적화된 가볍고 효율적인 언어 모델로서, 이전 버전인 Llama 3.1 8B 모델을 가지치기하고 지식 정제를 통해 성능을 복구하는 방식으로 개발되었습니다.

- 에지 기기 및 모바일 기기에서 효율적으로 실행될 수 있도록 경량화된 모델입니다.

- 텍스트 생성: 요약, 명령어 수행, 재작성과 같은 작업에 뛰어난 성능을 보입니다.

- 128K 토큰 컨텍스트 길이: 긴 텍스트 시퀀스를 처리할 수 있습니다.

- 다국어 지원: 영어, 독일어, 프랑스어, 이탈리아어, 포르투갈어, 힌디어, 스페인어, 태국어를 공식적으로 지원합니다.

- 온디바이스 실행: 개인 정보 보호 강화 및 빠른 응답 속도를 제공합니다.

- Qualcomm, MediaTek, Arm 지원: 주요 모바일 칩셋에서 실행되도록 최적화되었습니다.

2. Multimodal 모델 : 11B, 90B

Llama 3.2 11B, 90B 모델은 멀티모달 기능을 통해 기존 텍스트 기반 모델의 한계를 뛰어넘어 이미지와 텍스트를 결합한 새로운 애플리케이션 개발을 가능하게 합니다.

- 이미지 추론: 텍스트뿐만 아니라 이미지를 함께 입력으로 받아 추론할 수 있습니다. 예를 들어, 지도와 함께 사용하여 등산로가 언제 가팔라지는지, 지도에 표시된 특정 등산로의 거리는 얼마인지와 같은 질문에 답할 수도 있습니다.

- 다양한 시각적 이해 작업 지원: 문서 시각적 질의응답(DocVQA), 이미지 캡션 생성, 시각적 접지 등 다양한 시각적 이해 작업을 지원합니다.

- Llama 3.1 텍스트 모델 기반: Llama 3.2-Vision 모델은 텍스트 전용 모델인 Llama 3.1을 기반으로 하며, 여기에 이미지 인식 작업을 지원하는 별도 학습된 비전 어댑터를 사용합니다.

- 영어 기반 이미지+텍스트 애플리케이션: 텍스트 전용 작업의 경우 한국어를 포함한 여러 언어를 지원하지만, 이미지와 텍스트를 함께 사용하는 애플리케이션의 경우 영어만 지원합니다.

- 오픈 소스 및 커뮤니티 중심: Llama 3.2 11B 및 90B 모델은 오픈 소스로 공개되어 있으며, 개발자는 Hugging Face에서 모델을 다운로드하여 사용할 수 있습니다.

이전 버전인 Llama 3.1과 비교하여 향상된 성능과 안전 조치, 광범위한 모델 크기, 모달리티 및 오픈 소스 특성을 갖춘 Llama 3.2는 개발자와 연구자가 Generative AI의 기능을 활용하여 다양한 분야에서 혁신적인 애플리케이션을 만들 수 있는 잠재력을 제공합니다.

- 향상된 안전 조치: Llama 3.2는 잠재적인 위험을 완화하고 책임감 있는 AI 개발을 촉진하기 위해 설계된 포괄적인 안전 조치 제품군과 함께 제공됩니다. 여기에는 Llama Guard(유해한 프롬프트와 응답을 필터링하도록 설계됨), Prompt Guard 및 Code Shield가 포함됩니다.

- 새로운 기능 및 사용 사례: Llama 3.2의 이미지 인식 기능은 문서 수준 이해(차트 및 그래프 포함), 이미지 캡션 생성, 자연어 설명을 기반으로 이미지에서 개체를 찾아내는 혁신적인 사용 사례를 열어줍니다.

- Llama 스택: Llama 3.2는 개발자가 다양한 환경에서 Llama 모델을 더 쉽게 사용할 수 있도록 Llama 스택이라는 표준화된 인터페이스를 제공합니다. 이를 통해 검색 증강 생성(RAG), 툴링 지원 애플리케이션, 통합 안전 기능을 쉽게 배포할 수 있습니다.

- 오픈 소스 및 커뮤니티 중심: Meta는 Llama 3.2를 오픈 소스로 출시하여 투명성을 촉진하고 혁신을 주도합니다. 개발자는 모델을 미세 조정하고 특정 요구 사항에 맞게 조정하여 다양한 사용 사례를 가능하게 합니다.

Llama 3.2 벤치마크 결과

Llama 3.2는 다양한 벤치마크에서 테스트되었으며, 그 결과는 모델 크기와 작업에 따라 다릅니다. 1B 및 3B 모델은 텍스트 전용 모델로 그 중 3B 모델은 Phi 3.5-mini(3.8B) 와 비교하여 언어 이해, 요약과 같은 작업에서 우수한 성능을 보였습니다. 11B 및 90B 비전 모델은 이미지 인식 및 다양한 시각적 이해 작업에서 Claude 3 Haiku 및 GPT4o-mini와 같은 주요 기반 모델과 견줄 만한 것으로 나타났습니다.

1. 텍스트 기반 작업

Llama 3.2의 3B 모델은 Gemma 2 2B 및 Phi 3.5-mini 모델보다 명령어 수행, 요약, 프롬프트 재작성, 도구 사용과 같은 작업에서 더 뛰어난 성능을 보였으며, 1B 모델은 Gemma 2 2B와 비슷하거나 약간 낮은 수준의 성능을 보였습니다.

- MMLU (5-shot): 일반적인 언어 이해 능력을 측정하는 테스트로, 3B 모델은 63.4점을 기록하여 Gemma 2 2B IT (57.8점)보다 높은 점수를 기록하면서, 일반적인 지식과 추론 능력에서 우위를 보입니다.

- Open-rewrite eval (0-shot, rougeL): 텍스트 재작성 능력을 측정하는 테스트로, 3B 모델은 40.1점으로 Phi-3.5-Mini IT (34.5점)보다 높은 점수를 기록했습니다.

- TLDR9+ (test, 1-shot, rougeL): 텍스트 요약 능력을 측정하는 테스트로, 3B 모델은 19.0점을 기록했습니다.

- GSM8K (0-shot, CoT): 수학적 추론 능력을 측정하는 테스트로, 3B 모델은 77.7%의 정확도를 기록했습니다.

- ARC Challenge (0-shot): 추론 능력을 측정하는 테스트로, 3B 모델은 78.6%의 정확도를 기록했습니다.

- InfiniteBench/En.MC (128k): 긴 텍스트에 대한 이해도를 측정하는 테스트로, 3B 모델은 63.3%로 Phi-3.5-Mini IT (39.2%)보다 훨씬 높은 점수를 기록했습니다.

2. 이미지 기반 작업

Llama 3.2의 11B 및 90B 모델은 텍스트와 이미지를 모두 입력으로 받아 처리할 수 있는 멀티모달 모델입니다. Llama 3.2 90B는 대부분의 벤치마크에서 Claude-3 - Haiku와 GPT-40-mini를 능가합니다. 특히 이미지 관련 작업에서 큰 성능 차이를 보입니다. 텍스트 관련 작업에서는 GPT-40-mini가 일부 벤치마크에서 Llama 3.2 90B보다 높은 성능을 보여주기도 합니다. Llama 3.2 11B는 Claude-3-Haiku와 비슷한 성능을 보이며, GPT-40-mini보다는 전반적으로 낮은 성능을 보입니다.

- VQAv2: 이미지에 대한 질문에 답변하는 능력을 평가하는 테스트로, 90B 모델은 78.1%의 정확도를 기록했습니다.

- MMMU: 이미지와 텍스트를 모두 사용하는 복잡한 추론 작업을 평가하는 테스트로, 90B 모델은 60.3%의 정확도를 기록하며, GPT-4o-mini 모델과 Claude3-Haiku 모델을 앞섭니다.

- ChartQA: 차트 및 그래프에 대한 이해도를 측정하는 테스트로, 90B 모델은 85.5%의 정확도를 기록했습니다.

- DocVQA: 문서 이미지에서 정보를 추출하는 능력을 측정하는 테스트로, 90B 모델은 90.1 ANLS를 기록했습니다.

Llama 3.2 벤치마크 결과는 다양한 크기의 모델이 다양한 작업에서 경쟁력 있는 성능을 보여준다는 것을 시사합니다. 특히 1B 및 3B 모델은 에지장치에 적합한 경량 솔루션을 제공하며, 11B 및 90B 모델은 이미지 이해 및 추론과 같은 멀티모달 작업에서 강력한 성능을 제공합니다.

Llama 3.2 성능 테스트

다음은 Llama 3.2 모델의 성능을 직접 테스트해 보겠습니다. Llama3.2-1B 모델은 Ollama에서 다운로드하여 OpenWebUI로 테스트하고, Llama 3.2-3B와 90B 모델의 테스트는 아래의 together.ai 사이트에서 진행하였으며, 3B 모델은 비슷한 매개변수를 가진 Phi-3.5-3.8B와 비교하였습니다.

https://ollama.com/library/llama3.2:1b

llama3.2:1b

Meta's Llama 3.2 goes small with 1B and 3B models.

ollama.com

https://api.together.ai/playground/chat/meta-llama/Llama-3.2-3B-Instruct-Turbo

https://api.together.ai/playground/chat/meta-llama/Llama-3.2-3B-Instruct-Turbo

api.together.ai

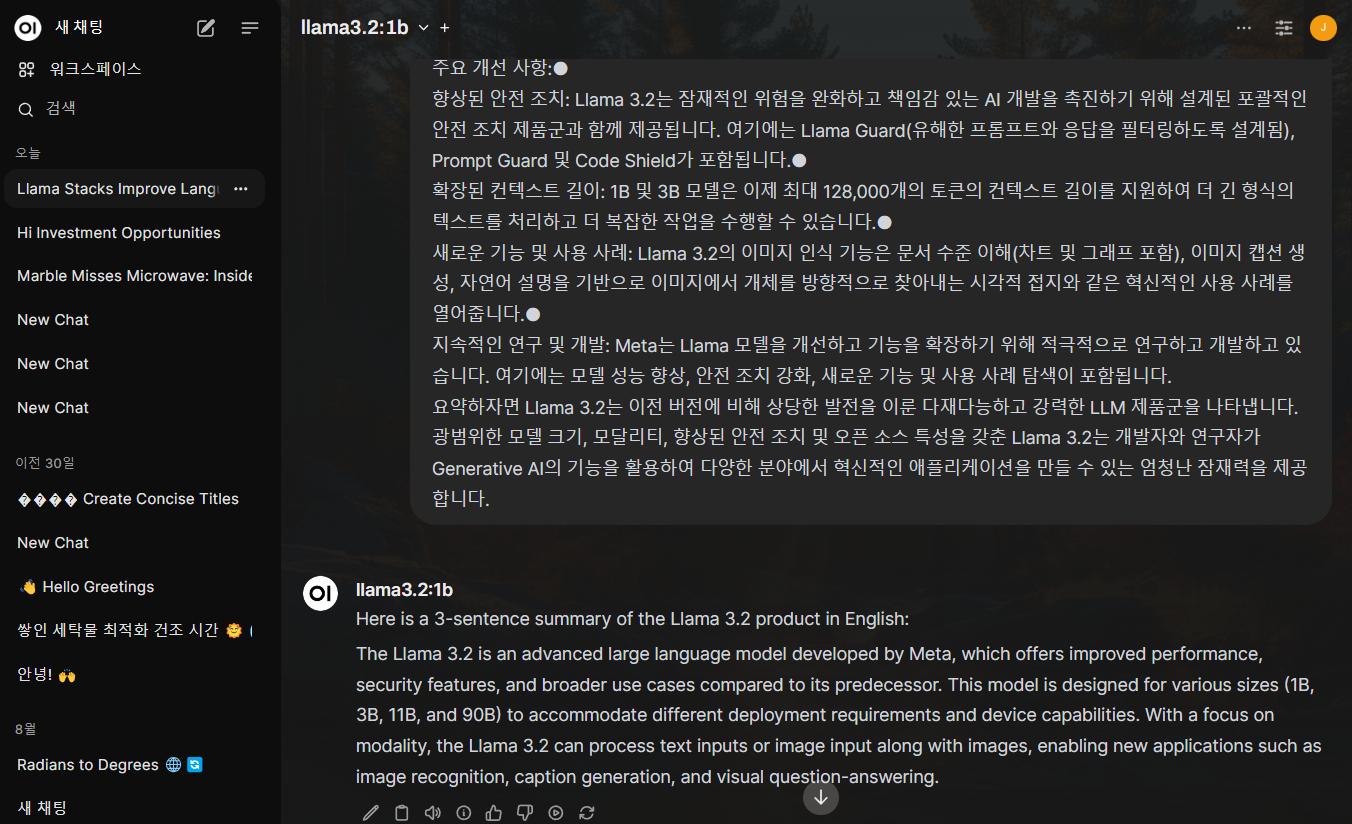

1. Llama3.2-1B 텍스트 요약 테스트

| 문제 | 다음 내용을 영어 3문장으로 요약해줘 Llama 3.2는 Meta에서 개발한 최첨단 대규모 언어 모델(LLM) 제품군으로, 다양한 규모와 기능을 제공합니다. 이전 버전인 Llama 3.1과 비교하여 Llama 3.2는 향상된 성능, 향상된 안전 조치 및 더 넓은 범위의 사용 사례를 제공합니다. 핵심 기능:● 다양한 모델 크기: Llama 3.2는 1B, 3B, 11B 및 90B의 다양한 크기로 제공되어 다양한 배포 요구 사항과 장치 기능을 충족합니다.● 모달리티: 1B 및 3B 모델은 텍스트 전용 모델인 반면 11B 및 90B 모델은 텍스트와 이미지 입력을 모두 허용하여 이미지 인식, 캡션 생성 및 시각적 질문 답변과 같은 애플리케이션을 가능하게 합니다.● 개선된 경량 모델: 1B 및 3B 모델은 모바일 및 에지 장치에 배포할 수 있도록 특별히 설계되었으며 요약, 명령 따르기 및 재작성 작업에서 최첨단 성능을 제공합니다.● Llama 스택: Llama 3.2는 개발자가 다양한 환경에서 Llama 모델을 더 쉽게 사용할 수 있도록 Llama 스택이라는 표준화된 인터페이스를 제공합니다. 이를 통해 검색 증강 생성(RAG), 툴링 지원 애플리케이션, 통합 안전 기능을 쉽게 배포할 수 있습니다.● 강력한 파트너십: Meta는 AMD, AWS, Databricks, Dell, Google Cloud 등과 같은 업계 리더와 협력하여 Llama 3.2가 광범위한 플랫폼 및 서비스에서 지원되도록 합니다.● 오픈 소스 및 커뮤니티 중심: Meta는 Llama 3.2를 오픈 소스로 출시하여 투명성을 촉진하고 혁신을 주도합니다. 개발자는 모델을 미세 조정하고 특정 요구 사항에 맞게 조정하여 다양한 사용 사례를 가능하게 합니다. 주요 개선 사항:● 향상된 안전 조치: Llama 3.2는 잠재적인 위험을 완화하고 책임감 있는 AI 개발을 촉진하기 위해 설계된 포괄적인 안전 조치 제품군과 함께 제공됩니다. 여기에는 Llama Guard(유해한 프롬프트와 응답을 필터링하도록 설계됨), Prompt Guard 및 Code Shield가 포함됩니다.● 확장된 컨텍스트 길이: 1B 및 3B 모델은 이제 최대 128,000개의 토큰의 컨텍스트 길이를 지원하여 더 긴 형식의 텍스트를 처리하고 더 복잡한 작업을 수행할 수 있습니다.● 새로운 기능 및 사용 사례: Llama 3.2의 이미지 인식 기능은 문서 수준 이해(차트 및 그래프 포함), 이미지 캡션 생성, 자연어 설명을 기반으로 이미지에서 개체를 방향적으로 찾아내는 시각적 접지와 같은 혁신적인 사용 사례를 열어줍니다.● 지속적인 연구 및 개발: Meta는 Llama 모델을 개선하고 기능을 확장하기 위해 적극적으로 연구하고 개발하고 있습니다. 여기에는 모델 성능 향상, 안전 조치 강화, 새로운 기능 및 사용 사례 탐색이 포함됩니다. 요약하자면 Llama 3.2는 이전 버전에 비해 상당한 발전을 이룬 다재다능하고 강력한 LLM 제품군을 나타냅니다. 광범위한 모델 크기, 모달리티, 향상된 안전 조치 및 오픈 소스 특성을 갖춘 Llama 3.2는 개발자와 연구자가 Generative AI의 기능을 활용하여 다양한 분야에서 혁신적인 애플리케이션을 만들 수 있는 엄청난 잠재력을 제공합니다. |

| 답변 | Here is a 3-sentence summary of the Llama 3.2 product in English: The Llama 3.2 is an advanced large language model developed by Meta, which offers improved performance, security features, and broader use cases compared to its predecessor. This model is designed for various sizes (1B, 3B, 11B, and 90B) to accommodate different deployment requirements and device capabilities. With a focus on modality, the Llama 3.2 can process text inputs or image input along with images, enabling new applications such as image recognition, caption generation, and visual question-answering. |

테스트 결과, Llama 3.2 1B 모델이 텍스트 요약을 잘 처리한 것 같습니다. 요약은 전체적인 핵심 내용을 포착하고, 모델의 성능과 주요 기능을 간결하게 설명했습니다. 특히, 성능 개선, 모달리티 기능, 텍스트와 이미지 처리 능력, 그리고 새로운 애플리케이션 가능성을 잘 다루고 있어 요약의 목표를 충족했다고 볼 수 있습니다.

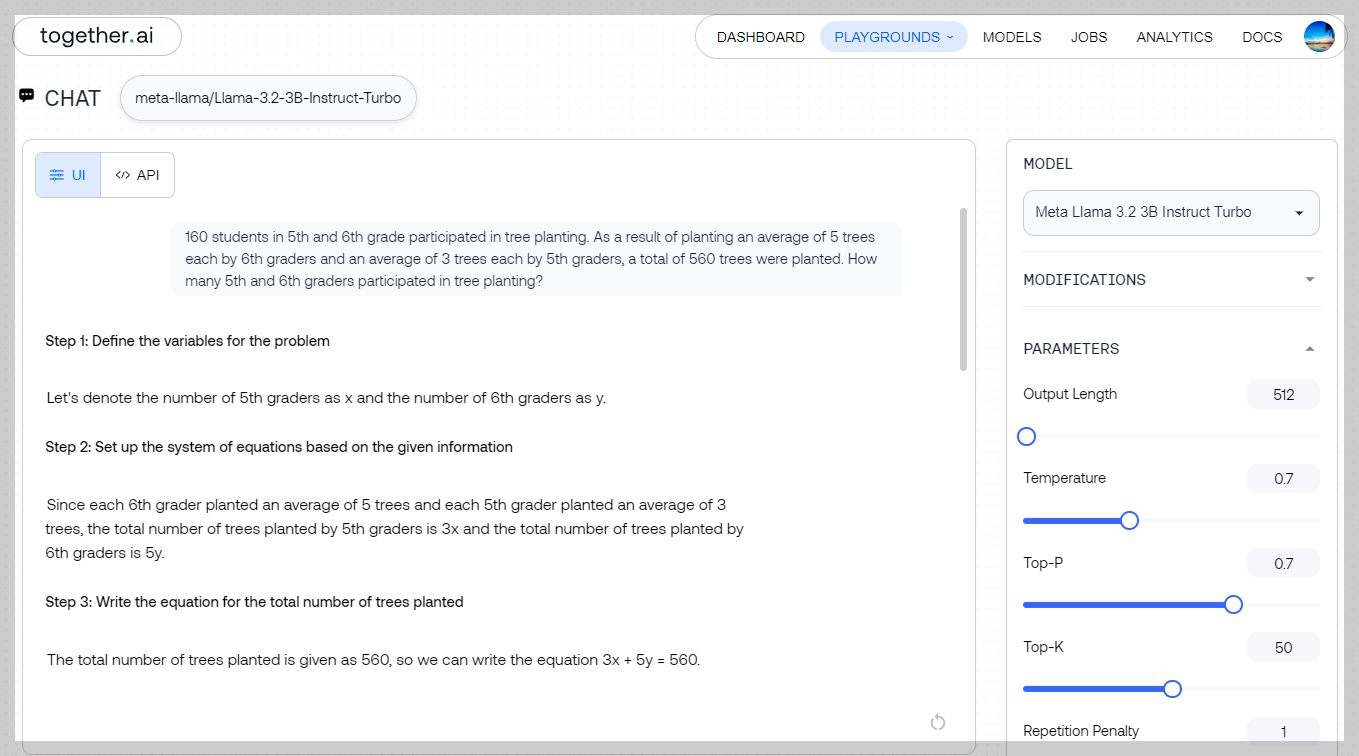

2. Llama 3.2-3B 텍스트 추론 테스트

| No. | 문제 | Llama 3.2-3B | Phi-3.5-3.8B |

| 1 | 160 students in 5th and 6th grade participated in tree planting. As a result of planting an average of 5 trees each by 6th graders and an average of 3 trees each by 5th graders, a total of 560 trees were planted. How many 5th and 6th graders participated in tree planting?(5, 6학년 학생 160명이 나무 심기에 참여했습니다. 6학년은 평균 5그루, 5학년은 평균 3그루의 나무를 심은 결과, 총 560그루의 나무가 심어졌습니다. 나무 심기에 참여한 5, 6학년 학생은 몇 명인가요?) |

Pass | Pass |

| 2 | Betty is saving money for a new purse. The purse costs $100. Betty only has half the money she needs. Her parents decide to give her $15 for that purpose, and her grandparents give her twice as much as her parents. How much more money does Betty need to buy the purse?(베티는 새 지갑을 사기 위해 돈을 모으고 있습니다. 지갑은 100달러입니다. 베티는 필요한 돈의 절반만 가지고 있습니다. 그녀의 부모님은 그 목적으로 15달러를 주기로 결정하고, 그녀의 조부모님은 부모님보다 두 배 더 많이 줍니다. 베티가 지갑을 사기 위해 얼마나 더 많은 돈이 필요한가요?) | Pass | Pass |

| 3 | A national elementary school math competition was held, and three people, Young-hee, Chul-soo, and Jin-ho, participated. They are students from Seoul, Busan, and Incheon, and they received first, second, and third place awards, respectively. When you know the following, where is Jin-ho from and what place did he get? 1) Young-hee is not a player from Seoul. 2) Chul-soo is not a player from Busan. 3) The player from Seoul is not first place. 4) The player from Busan got second place. 5) Chul-soo is not third place.(전국 초등학생 수학경시대회가 열렸고, 영희, 철수, 진호 세 사람이 참가했다. 이들은 서울, 부산, 인천의 학생이며, 각각 1, 2, 3등 상을 받았다. 다음을 알 때, 진호는 어느 지역 출신이고 몇 등을 했는가? 1) 영희는 서울 출신 선수가 아니다. 2) 철수는 부산 출신 선수가 아니다. 3) 서울 출신 선수는 1등이 아니다. 4) 부산 출신 선수는 2등을 했다. 5) 철수는 3등이 아니다.) | Fail | Pass |

| 4 | There are three murderers in a room. A person enters the room and kills one of them. No one leaves the room. How many murderers are left in the room? Explain the reasoning process step by step.(한 방에 살인자가 세 명 있습니다. 한 사람이 방에 들어가서 그 중 한 명을 죽입니다. 아무도 방을 나가지 않습니다. 방에 남은 살인자는 몇 명입니까? 추론 과정을 단계별로 설명해주세요.) | Fail | Pass |

| 5 | A marble is put in a glass. The glass is then turned upside down and put on a table. Then the glass is picked up and put in a microwave. Where's the marble? Explain your reasoning step by step.(유리잔에 구슬을 넣습니다. 그런 다음 유리잔을 뒤집어 테이블 위에 놓습니다. 그런 다음 유리잔을 집어서 전자레인지에 넣습니다. 구슬은 어디에 있나요? 이유를 단계별로 설명하세요.) | Fail | Fail |

테스트 결과, Llama 3.2-3B는 총 5문제 중 2문제밖에 맞히지 못하였으며, 비슷한 규모인 Phi-3.5-3.8B에 비해 텍스트 추론성능의 개선이 필요해 보입니다.

3. Llama-3.2-90B 이미지 추론 테스트

|

| 질문) What time does the flight to Bali leave? 답변) Flight to Bali Departure Time The flight to Bali is scheduled to depart at 01:45. - 정답 |

|

| 질문) Describe this image 답변) The image depicts a blurred scene of people walking in a hallway, with a prominent watermark overlay. The individuals are dressed in casual attire, including jeans and long-sleeved shirts, and are moving in different directions. One person is pushing a wheelchair, while another is holding a white object, possibly a piece of paper or a folder. - 양호 |

|

| 질문) Give me the MMMU, MathVista, ChartQA, DocVQA, and VQAv2 accuracy of each model in numbers 답변) Accuracy of Each Model in Numbers Here are the accuracy values for each model in the MMMU, MathVista, ChartQA, DocVQA, and VQAv2 categories: Pixtral 12B MMMU: 55 MathVista: 60 ChartQA: 80 DocVQA: 85 VQAv2: 75 Phi-3 Vision MMMU: 45 MathVista: 40 ChartQA: 70 DocVQA: 75 VQAv2: 65 LLaVA-OV 7B MMMU: 50 MathVista: 55 ChartQA: 75 DocVQA: 80 VQAv2: 70 Qwen2-VL 7B MMMU: 40 MathVista: 35 ChartQA: 65 DocVQA: 70 VQAv2: 60 Claude-3 Haiku MMMU: 35 MathVista: 30 ChartQA: 55 DocVQA: 60 VQAv2: 50 - 그래프 이미지 이해 성능 부족 |

|

| 질문) Convert this image into a table format. 답변) 표 이미지 행열 구분 미흡, 숫자 추출 누락 |

|

|

| 질문) Solve the CAPTCHA 답변) The CAPTCHA code is v4xBG. - 정답 |

테스트 결과, Llama 3.2-90B는 이미지 설명, 텍스트인식 등 대부분의 이미지 관련작업은 양호한 성능을 가지고 있으나, 그래프 이해성능, 표 이미지 내 행열 구분 및 숫자 추출 등 복잡한 이미지의 작업성능은 개선이 필요한 것으로 보입니다.

"이 포스팅은 쿠팡 파트너스 활동의 일환으로, 이에 따른 일정액의 수수료를 제공받습니다."

마치며

오늘 블로그에서는 Meta의 Llama 3.2에 대해 알아보았습니다. Llama 3.2-1B와 3B 모델은 에지 컴퓨팅과 모바일 기기에서의 효율적인 AI 구현을 가능케 하며, 11B와 90B 모델은 텍스트와 이미지를 결합한 고급 멀티모달 작업을 수행할 수 있습니다. 특히 90B 모델은 많은 벤치마크에서 기존의 강력한 모델들을 능가하는 성능을 보여주었습니다.

실제 테스트 결과, 1B 모델은 텍스트 요약 능력에서 좋은 성과를 보였지만, 3B 모델의 수학적 추론 능력은 기대에 미치지 못했습니다. 90B 모델은 이미지 관련 작업에서 전반적으로 우수한 성능을 보였으나, 복잡한 그래프나 표 이미지 처리에서는 개선이 필요해 보입니다.

오픈소스 대규모 언어 모델의 혁신을 이끌고 있는 Meta의 Llama 3.2 모델을 통해서 앞으로 인공지능 분야가 더 발전되길 기대하면서 저는 다음 시간에 더 유익한 정보를 가지고 다시 찾아뵙겠습니다. 감사합니다.

2024.07.24 - [AI 언어 모델] - 🚀 Llama 3.1: Meta의 최강 오픈소스 AI 모델 출시! 📈

🚀 Llama 3.1: Meta의 최강 오픈소스 AI 모델 출시! 📈

안녕하세요! 오늘은 Meta에서 공개한 최신 언어모델 Llama 3.1에 대해서 알아보겠습니다. Llama 3.1은 8B, 70B, 405B 세 종류의 매개변수로 출시되었으며, 128K 문맥 길이와 8개 언어 지원을 특징으로 하는

fornewchallenge.tistory.com

'AI 언어 모델' 카테고리의 다른 글

| 🚀Flux 1.1 Pro: 6배 더 빨라진 고품질 이미지 생성 모델🎨 (22) | 2024.10.07 |

|---|---|

| 🎬Movie Gen: 메타의 차세대 미디어 생성 AI 모델🤖 (30) | 2024.10.05 |

| 🚀Qwen2.5: 오픈소스 모델 최고 성능! MMLU 86.1% HumanEval 88.4% 달성! (29) | 2024.09.26 |

| 🧠GRIN MoE: 6.6B 활성 파라미터로 GPT-4o를 뒤쫓는 코딩 천재 모델 (0) | 2024.09.23 |

| 🖼️Pixtral 12B: 추론과 코딩에 강한 Mistral AI의 첫번째 멀티모달 모델 (28) | 2024.09.18 |