안녕하세요! 오늘은 알리바바에서 공개한 Qwen 시리즈의 최신 모델, QwQ-32B에 대해 알아보겠습니다. QwQ-32B는 기존의 지도 학습 모델과 차별화된 추론 중심 AI 모델로, 생각하고 분석하는 능력을 갖추고 있습니다. 특히 수학, 코딩, 논리적 사고에서 강력한 성능을 발휘하며, DeepSeek-R1, o1-mini와 같은 최신 AI 모델과 경쟁할 수 있는 수준의 성능을 제공합니다. 또한, 강화 학습(RL) 기법을 통해 더욱 정교한 문제 해결 능력을 갖춘 것이 특징입니다. 이번 블로그에서는 QwQ-32B의 주요 사양과 기능, 벤치마크 성능, 그리고 실제 코딩, 수학, 추론 테스트 결과를 살펴보며, 이 모델이 AI 분야에서 어떤 가능성을 보여주는지 분석해 보겠습니다. 그럼, 함께 살펴볼까요?

"이 포스팅은 쿠팡 파트너스 활동의 일환으로, 이에 따른 일정액의 수수료를 제공받습니다."

1. QwQ-32B 개요 및 사양

QwQ-32B는 Qwen 시리즈의 추론 모델입니다. 기존의 지도 학습 모델과 비교했을 때, QwQ는 생각하고 추론하는 능력을 갖추고 있어 특히 어려운 문제에서 향상된 성능을 제공합니다. QwQ-32B는 중간 규모의 추론 모델로서, DeepSeek-R1, o1-mini와 같은 최첨단 추론 모델과 경쟁적인 성능을 달성할 수 있습니다.

QwQ-32B는 우수한 성능에도 Apache 2.0 라이선스 하에 Hugging Face와 ModelScope에서 오픈 소스로 제공되며, 모델의 주요 사양은 다음과 같습니다:

|

항목

|

주요 사양

|

|

모델 유형

|

Causal Language Models

|

|

학습 단계

|

Pretraining & Post-training (Supervised Finetuning 및 Reinforcement Learning)

|

|

구조

|

transformers with RoPE, SwiGLU, RMSNorm, Attention QKV bias

|

|

파라미터 수

|

32.5B (Embedding 제외 시 31.0B)

|

|

레이어 수

|

64

|

|

Attention 헤드 수 (GQA)

|

Q: 40개, KV: 8개

|

|

컨텍스트 길이

|

131,072 토큰

|

2. QwQ-32B 특징 및 주요 기능

QwQ-32B는 강화 학습(Reinforcement Learning)을 통해 모델의 성능을 향상했습니다. 강화 학습은 기존의 사전 학습 및 사후 학습 방법을 넘어서 모델의 성능을 향상시킬 수 있는 잠재력을 가지고 있습니다. DeepSeek R1은 콜드 스타트 데이터와 다단계 학습을 통합하여 최첨단 성능을 달성했습니다.

- 강화 학습을 통한 추론 능력 향상: QwQ-32B는 강화 학습을 통해 수학적 추론, 코딩 능력 및 일반적인 문제 해결 능력을 향상.

- 도구 활용 및 환경 피드백 기반 추론: 에이전트 관련 기능을 추론 모델에 통합하여 도구를 활용하고 환경 피드백에 따라 추론을 조정.

- 오픈 웨이트: Hugging Face 및 ModelScope에서 Apache 2.0 라이선스로 사용 가능.

강화 학습은 에이전트가 환경과 상호작용하며, 보상을 최대화하는 행동(정책)을 학습하는 머신러닝의 한 분야입니다. Scaling Reinforcement Learning은 이러한 강화 학습을 더 복잡한 문제에 적용하기 위해, 병렬 처리, 모델 기반 강화 학습, 경험 재사용(Replay Buffer 확장), 정책 최적화 기법 등을 통해, 모델의 크기, 데이터의 양, 알고리즘의 효율성, 그리고 분산 학습 등을 확장하는 것을 의미합니다.

https://qwenlm.github.io/blog/qwq-32b/

QwQ-32B: Embracing the Power of Reinforcement Learning

QWEN CHAT Hugging Face ModelScope DEMO DISCORD Scaling Reinforcement Learning (RL) has the potential to enhance model performance beyond conventional pretraining and post-training methods. Recent studies have demonstrated that RL can significantly improve

qwenlm.github.io

3. QwQ-32B 벤치마크 결과

QwQ-32B는 다양한 벤치마크에서 평가되었으며, 수학적 추론, 코딩 능력 및 일반적인 문제 해결 능력을 평가하도록 설계되었습니다. QwQ-32B 모델 소개 블로그에 공개된 벤치마크 결과는 다음과 같습니다:

이 그래프는 QwQ-32B 모델과 다른 AI 모델들의 벤치마크 성능 비교 결과를 보여주고 있습니다. 전반적으로 QwQ-32B는 파라미터 수가 더 많은 모델들과 비교해도 경쟁력 있는 성능을 보여주고 있으며, 특히 일부 벤치마크에서는 최고 성능을 보여주고 있습니다.

평가된 벤치마크:

- AIME24(수학 문제 해결 능력): 79.5점을 기록했으며, DeepSeek-R1-671B와 비슷한 수준(79.8)입니다.

- LiveCodeBench(코드 생성 및 소프트웨어 개발 능력): 63.4점으로, DeepSeek-R1-671B(65.9)보다 약간 낮습니다.

- LiveBench(일반적인 자연어 처리 및 코드 관련 능력): 73.1점으로, DeepSeek-R1-671B(71.6)보다 약간 높습니다.

- IFEval(자연어 이해 및 추론 능력): 83.9점으로, 이 벤치마크에서 매우 좋은 성능을 보여주고 있으며 DeepSeek-R1-671B(83.3)와 비슷합니다.

- BFCL(함수 호출 및 코드실행 정확성): 66.4점으로, 다른 모델들보다 높은 점수를 기록했습니다.

QwQ-32B는 파라미터 수가 32B로, 대부분의 벤치마크에서 671B 파라미터를 가진 DeepSeek-R1-671B와 비교해도 비슷하거나 더 좋은 성능을 보입니다. 특히 BFCL 벤치마크에서는 모든 비교 모델 중에서 가장 높은 점수를 기록했습니다.

또한, 벤치마크 업체 Artificial Analysis(https://artificialanalysis.ai/)에 따르면, QwQ-32B는 다단계 추론과 전문 분야 지식을 평가하는 GPQA Diamond에서 59.5%, 대학 수준의 수학적 추론 능력을 평가하는 AIME 2024는 78%를 기록했습니다.

- GPQA Diamond: 59.5%로, DeepSeek R1의 71%에는 못 미치지만 Gemini 2.0 Flash의 62% 바로 아래에 위치합니다.

- AIME 2024: 78%로, DeepSeek R1을 능가하고, o3-mini-high를 제외한 다른 모델보다 뛰어납니다.

4. QwQ-32B 성능 테스트

다음은 QwQ-32B의 성능을 테스트해 보겠습니다. https://chat.qwen.ai/ 에 접속해서 아래 화면과 같이 QwQ-32B 모델을 선택하고 테스트 프롬프트를 입력하면 됩니다.

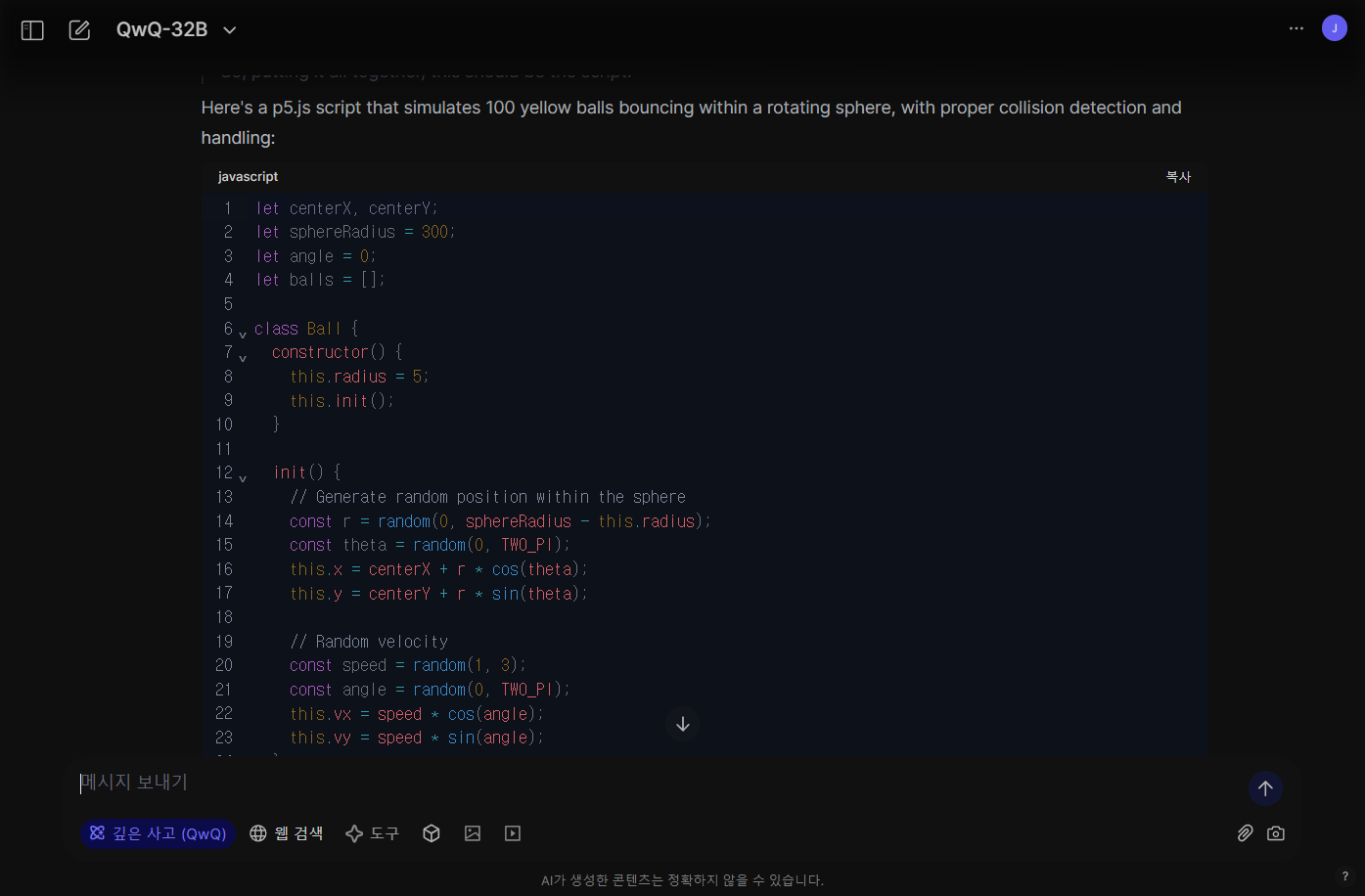

- 구면 내에서 튀는 100개의 노란색 공 생성 스크립트: 천천히 회전하는 구 내에서 노란색 공이 머무르면서 충돌 감지를 처리하는 스크립트를 p5.js로 구현하기

write a script for 100 bouncing yellow balls within a sphere, make sure to handle collision detection properly. make the sphere slowly rotate. make sure balls stays within the sphere. implement it in p5.js

구면 내에서 100개의 튀는 노란색 공에 대한 스크립트를 작성해줘, 충돌 감지를 제대로 처리해야 해. 구가 천천히 회전하도록 해줘. 공이 구 안에 머무르도록 해줘. p5.js로 구현해줘

Qwen2.5-VL-72B-Instruct에게 물어본 결과, 노란 공의 개수는 100개로 정확하게 생성한 것을 알 수 있었습니다.

- 지구-화성 탐사궤도 애니메이션 생성: 우주선이 지구에서 출발해서 화성까지 갔다가 돌아오는 애니메이션 구현

Generate code for an animated 3D plot of a launch from earth landing on mars and then back to earth at the next launch window

지구에서 화성에 착륙한 후 다음 발사 창에서 지구로 돌아오는 애니메이션 3D 플롯에 대한 코드를 생성해줘

Claude-3.7-Sonnet를 활용해서 동일한 프롬프트로 QwQ-Max-Preview가 생성했던 코드와 비교해 본 결과, QwQ-Max-Preview가 과학적으로 더 정확한 구현을 했다고 답하였습니다.

다음은 QwQ-32B의 코딩, 수학, 추론 성능을 테스트해 보겠습니다.

1) 코딩 테스트

| QwQ-32B | Medium | Hard | Very Hard | Expert |

| Python | Pass | Pass | Pass | Pass |

| JavaScript | Pass | Pass | Pass | Pass |

| C++ | Pass | Pass | Pass | Pass |

코딩 테스트 결과 QwQ-32B는 모든 난이도 문제를 성공하였으며, QwQ-Max-Preview가 C++ Expert 난이도 문제를 해결하는 과정에서 4만 자의 추론 토큰을 출력한데 비해, 절반 수준인 약 2만 자의 추론 토큰을 출력하였습니다.

2) 수학 테스트

| No. | 문제 구분 | 문제 | QwQ-32B |

| 1 | 기초 대수 문제 | 두 숫자 𝑥 x와 𝑦 y가 있습니다. 이들이 만족하는 식은 3 𝑥 + 4 𝑦 = 12 3x+4y=12이며, 𝑥 − 2 𝑦 = 1 x−2y=1입니다. 𝑥 x와 𝑦 y의 값을 구하세요 | Pass |

| 2 | 기하학 문제 | 반지름이 7cm인 원의 넓이를 구하세요. 𝜋 = 3.14159 π=3.14159로 계산하세요. | Pass |

| 3 | 확률 문제 | 주사위를 두 번 던졌을 때, 두 숫자의 합이 7이 될 확률을 구하세요. | Pass |

| 4 | 수열 문제 | 첫 번째 항이 3이고, 공차가 5인 등차수열의 10번째 항을 구하세요. | Pass |

| 5 | 최적화 문제 | 어떤 직사각형의 둘레가 36cm입니다. 이 직사각형의 넓이를 최대화하려면 가로와 세로의 길이는 각각 얼마여야 하나요? | Pass |

| 6 | 복합 문제 | 복소평면에서 다음 극한값을 구하시오. lim[n→∞] (1 + i/n)^(n^2) 여기서 i는 허수단위 (i^2 = -1)입니다. | Pass |

수학 테스트에서 QwQ-32B는 기초 대수, 기하학, 확률, 수열, 최적화, 복합문제 등 6문제를 모두 성공하였습니다.

3) 추론 테스트

| No. | 문제 | QwQ-32B |

| 1 | 5학년과 6학년 학생 160명이 나무 심기에 참가하였습니다. 6학년 학생들이 각각 평균5그루,5학년 학생들이 각각 평균 3그루씩 심은 결과 모두 560그루를 심었습니다. 나무심기에 참가한 5,6학년 학생은 각각 몇명일까요? |

Pass |

| 2 | 베티는 새 지갑을 위해 돈을 모으고 있습니다. 새 지갑의 가격은 $100입니다. 베티는 필요한 돈의 절반만 가지고 있습니다. 그녀의 부모는 그 목적을 위해 $15를 주기로 결정했고, 할아버지와 할머니는 그녀의 부모들의 두 배를 줍니다. 베티가 지갑을 사기 위해 더 얼마나 많은 돈이 필요한가요? | Pass |

| 3 | 전국 초등학생 수학경시대회가 열렸는데 영희,철수,진호 세사람이 참가했습니다. 그들은 서울,부산,인천에서 온 학생이고 각각 1등,2등,3등 상을 받았습니다. 다음과 같은 사항을 알고 있을때 진호는 어디에서 온 학생이고 몇등을 했습니까? 1) 영희는 서울의 선수가 아닙니다. 2) 철수는 부산의 선수가 아닙니다. 3)서울의 선수는 1등이 아닙니다. 4) 부산의 선수는 2등을 했습니다. 5)철수는 3등이 아닙니다. | Pass |

| 4 | 방 안에는 살인자가 세 명 있습니다. 어떤 사람이 방에 들어와 그중 한 명을 죽입니다. 아무도 방을 나가지 않습니다. 방에 남아 있는 살인자는 몇 명입니까? 단계별로 추론 과정을 설명하세요. | Pass |

| 5 | A marble is put in a glass. The glass is then turned upside down and put on a table. Then the glass is picked up and put in a microwave. Where's the marble? Explain your reasoning step by step. | Pass |

| 도로에 5대의 큰 버스가 차례로 세워져 있는데 각 차의 뒤에 모두 차의 목적지가 적혀져 있습니다. 기사들은 이 5대 차 중 2대는 A시로 가고, 나머지 3대는 B시로 간다는 사실을 알고 있지만 앞의 차의 목적지만 볼 수 있습니다. 안내원은 이 몇 분의 기사들이 모두 총명할 것으로 생각하고 그들의 차가 어느 도시로 가야 하는지 목적지를 알려 주지 않고 그들에게 맞혀 보라고 하였습니다. 먼저 세번째 기사에게 자신의 목적지를 맞혀 보라고 하였더니 그는 앞의 두 차에 붙여 놓은 표시를 보고 말하기를 "모르겠습니다." 라고 말하였습니다. 이것을 들은 두번째 기사도 곰곰히 생각해 보더니 "모르겠습니다." 라고 말하였습니다. 두명의 기사의 이야기를 들은 첫번째 기사는 곰곰히 생각하더니 자신의 목적지를 정확하게 말하였습니다. 첫번째 기사가 말한 목적지는 어디입니까? | Pass |

QwQ-Max-Preview는 이 블로그의 코딩, 수학, 추론테스트를 모두 통과하였습니다.

| 구분 | 코딩 테스트 결과 | 수학 테스트 결과 | 추론 테스트 결과 | 평균 |

| QwQ-32B | 100 | 100 | 100 | 100 |

"이 포스팅은 쿠팡 파트너스 활동의 일환으로, 이에 따른 일정액의 수수료를 제공받습니다."

5. 맺음말

QwQ-32B는 강력한 추론 능력과 효율적인 학습 구조를 통해 다양한 영역에서 뛰어난 성능을 보여주었습니다. 특히, 코딩, 수학, 논리적 추론 테스트에서 안정적인 성과를 기록하며, 대형 모델과 비교해도 경쟁력 있는 결과를 보였습니다. 또한, 오픈 웨이트 정책을 통해 연구자와 개발자들이 자유롭게 활용할 수 있도록 지원하며, AI 모델의 발전에 기여하고 있습니다.

비싼 구독료의 상용모델에 버금가는 오픈소스 모델들이 등장하면서 AI 분야에 지각변동이 생기고 있는데요, 여러분도 아래 허깅페이스 데모페이지에서 한 번씩 테스트해 보시면 좋을 것 같습니다. 앞으로 QwQ-32B가 더욱 정교한 문제 해결 능력을 갖추고, 다양한 분야에서 실용적으로 활용될 수 있기를 기대하면서 저는 다음 시간에 더 유익한 정보를 가지고 다시 찾아뵙겠습니다. 감사합니다.

https://huggingface.co/spaces/Qwen/QwQ-32B-Demo

QwQ 32B Demo - a Hugging Face Space by Qwen

huggingface.co

2025.03.05 - [AI 언어 모델] - 🐪🤖 QwQ-Max-Preview: 알리바바의 최신 추론 모델 심층 분석 !

🐪🤖 QwQ-Max-Preview: 알리바바의 최신 추론 모델 심층 분석 !

안녕하세요! 오늘은 알리바바에서 공개한 Qwen 시리즈의 최신 모델, QwQ-Max-Preview에 대해 살펴보겠습니다. QwQ-Max-Preview는 기존 Qwen2.5-Max를 기반으로 더욱 강화된 추론 능력과 다재다능한 문제 해결

fornewchallenge.tistory.com

'AI 언어 모델' 카테고리의 다른 글

| 🤖✨ Gemma 3 모델 심층 분석: 구글의 차세대 개방형 멀티모달 AI (2) | 2025.03.15 |

|---|---|

| 🤖MS의 첫 멀티모달 AI, Phi-4-multimodal과 Phi-4-mini-3.8B 분석 (4) | 2025.03.09 |

| 🐪🤖 QwQ-Max-Preview: 알리바바의 최신 추론 모델 심층 분석 ! (10) | 2025.03.05 |

| 📹🚀🔓Wan2.1: Sora보다 강력한 알리바바의 최강 오픈소스 비디오 AI (7) | 2025.03.03 |

| 🌍🚀세계 최초 하이브리드 추론 모델 Claude 3.7 Sonnet과 Claude Code 분석 (4) | 2025.02.26 |