안녕하세요! 오늘은 최근 업데이트된 NVIDIA ChatRTX에 대해서 알아보겠습니다. NVIDIA ChatRTX는 사용자의 파일 및 데이터에 연결된 대형 언어 모델을 개인화하여 컨텍스트에 맞는 빠른 답변을 제공하는 데모 앱입니다. 이번 업데이트에서는 이미지 인식이 가능한 CLIP 모델과, ChatGLM 모델이 추가되었으며, 다양한 파일을 지원하며 음성 인식과 사진 앨범 정리도 가능하고, 모든 기능은 로컬에서 안전하게 실행됩니다. 이 블로그에서는 NVIDIA ChatRTX의 주요 기능, 특징과 장단점, 설치방법과 에러 해결방법 등에 대해 알아보겠습니다.

"이 포스팅은 쿠팡 파트너스 활동의 일환으로, 이에 따른 일정액의 수수료를 제공받습니다."

ChatRTX 특징 및 주요 기능

NVIDIA ChatRTX는 올해 2월 처음 공개된 사용자의 개인 파일 및 데이터에 연결되어 대형 언어 모델을 개인화할 수 있는 데모 앱으로, 이번 업데이트를 통해 CLIP 모델과 ChatGLM 모델이 추가되고, 음성 인식기능, 사진 앨범 검색기능이 추가되었습니다. YouTube URL 대화기능은 삭제되었습니다. 이전 버전의 자세한 내용은 아래 포스팅을 참고하시기 바랍니다.

2024.02.18 - [AI 도구] - 엔비디아의 최신 DEMO: Chat with RTX 설치 및 사용후기

엔비디아의 최신 DEMO: Chat with RTX 설치 및 사용후기

안녕하세요! 오늘은 최근 엔비디아에서 공개한 "Chat with RTX"의 설치 및 사용후기에 대해 작성해 보겠습니다. "Chat with RTX"는 사용자가 자신의 문서, 노트, 비디오 또는 기타 데이터에 연결된 GPT(Gene

fornewchallenge.tistory.com

이번 업데이트에서 추가된 CLIP 모델과 ChatGLM3 6B의 특징은 다음과 같습니다.

먼저 CLIP 모델은 이미지와 텍스트를 함께 이해할 수 있는 능력을 갖추고 있으며, 다음과 같은 특징을 가지고 있습니다:

- 비전-언어 이해: CLIP는 이미지와 텍스트를 모두 고려하여 이해하는데, 이는 사진과 그에 대한 설명 또는 텍스트 캡션을 함께 고려할 수 있음을 의미합니다.

- Cross-modal 학습: 이미지와 텍스트 간의 상호작용을 학습하여, 이미지와 텍스트 간의 유사성을 이해할 수 있습니다. 즉, 텍스트 설명이 주어졌을 때 해당 이미지를 찾거나, 이미지가 주어졌을 때 해당 텍스트 설명을 생성할 수 있습니다.

- 다양한 응용: 이미지 분류, 이미지 검색, 텍스트 기반 이미지 생성 등 다양한 응용 분야에서 활용될 수 있습니다.

- 다목적 모델: CLIP는 다목적으로 사용될 수 있으며, 이미지와 텍스트 간의 교차 모달 검색, 분류, 생성 및 이해와 같은 작업에 활용됩니다.

ChatGLM3-6B 모델은 영어와 중국어를 지원하는 ChatGLM3 시리즈의 오픈 소스 모델로, 함수호출, 코드해석 등 다양한 기능을 지원하며, 다음과 같은 특징을 가지고 있습니다:

- 강력한 베이스 모델: ChatGLM3-6B의 베이스 모델은 더 다양한 훈련 데이터셋, 충분한 훈련 단계 및 더 합리적인 훈련 전략을 채택합니다. ChatGLM3-6B-Base는 의미, 수학, 추론, 코드 및 지식과 같은 다양한 측면의 데이터셋을 평가한 결과 10B 미만의 베이스 모델 중 가장 강력한 성능을 보입니다.

- 보다 완전한 기능 지원: ChatGLM3-6B는 새롭게 설계된 프롬프트 형식을 채택하여 여러 턴의 대화를 지원합니다. 또한 도구 호출(함수 호출), 코드 실행(코드 해석기), 복잡한 시나리오에서의 에이전트 작업을 네이티브로 지원합니다.

- 보다 포괄적인 오픈 소스 시리즈: ChatGLM3-6B 대화 모델 외에도 ChatGLM3-6B-Base, ChatGLM3-6B-32K(긴 텍스트 대화 모델), ChatGLM3-6B-128K(더 긴 텍스트 이해 능력 강화) 등을 오픈 소스로 제공합니다.

이번 업데이트에서도 이전 버전과 같이 검색 증강 생성(Retrieval-Augmented Generation, RAG), TensorRT-LLM 및 RTX 가속을 활용하여 사용자는 컨텍스트에 맞는 답변을 빠르게 얻을 수 있습니다. 이 모든 것이 사용자의 Windows RTX PC에서 로컬로 실행되므로 빠르고 안전한 결과를 얻을 수 있습니다.

ChatRTX는 txt, pdf, doc/docx, jpg, png, gif, xml 등의 다양한 파일 형식을 포함하며, 사용자가 파일이 저장된 폴더를 가리키기만 하면 몇 초 안에 라이브러리에 로드됩니다. 또한 ChatRTX는 인공지능을 활용한 자동 음성 인식 시스템을 제공합니다. 사용자는 마이크 아이콘을 클릭하고 ChatRTX에게 말하기만 하면 다국어 지원을 통해 텍스트 응답을 제공받을 수 있으며, 사용자의 사진 앨범을 간편한 텍스트 또는 음성 검색으로 검색하고 정리할 수도 있습니다.

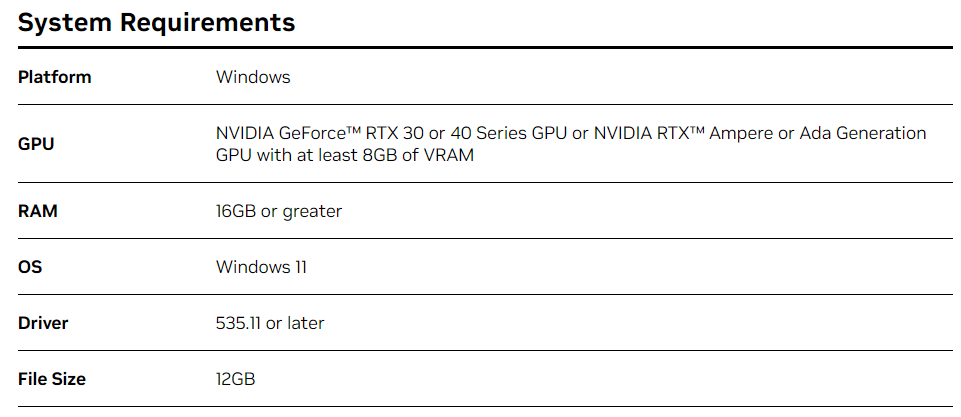

ChatRTX를 설치하기 위한 PC의 요구사양은 다음과 같습니다.

ChatRTX 설치방법

ChatRTX의 설치방법은 다음과 같습니다. ChatRTX의 이전 버전에서도 에러 때문에 많이 시간낭비를 했는데요, 이번 업데이트에서도 많은 사용자들이 설치에러를 경험하고 있는 것 같습니다. 제가 찾아본 결과 이번 버전의 설치 시에 발생하는 에러는 대부분 "miniconda" 관련 에러이며, 가상환경을 수동으로 생성해 주는 것으로 문제가 해결되고 있습니다.

- 1. 설치파일 다운로드(약 11GB)

- 2. 설치에러 방지를 위한 conda 가상환경 수동 생성

- 3. 설치 완료 및 실행

설치파일 다운로드는 아래 링크에서 하실 수 있으며, 설치파일의 크기는 약 11GB입니다.

https://www.nvidia.com/en-us/ai-on-rtx/chatrtx/

NVIDIA ChatRTX

Your Personalized AI Chatbot.

www.nvidia.com

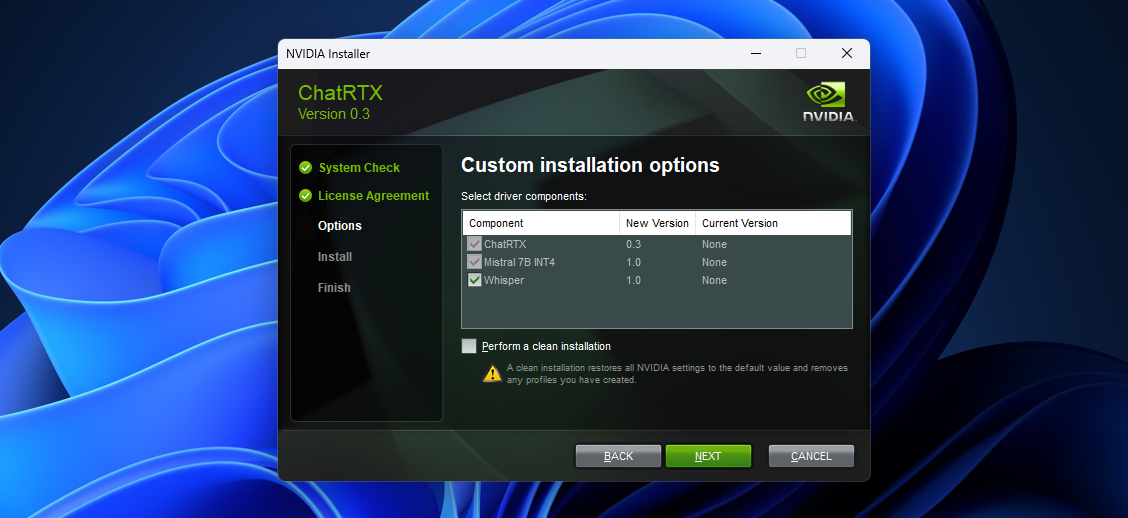

다운로드가 완료되고 설치파일을 실행하면 아래 화면과 같이 설치 프로세스가 시작됩니다.

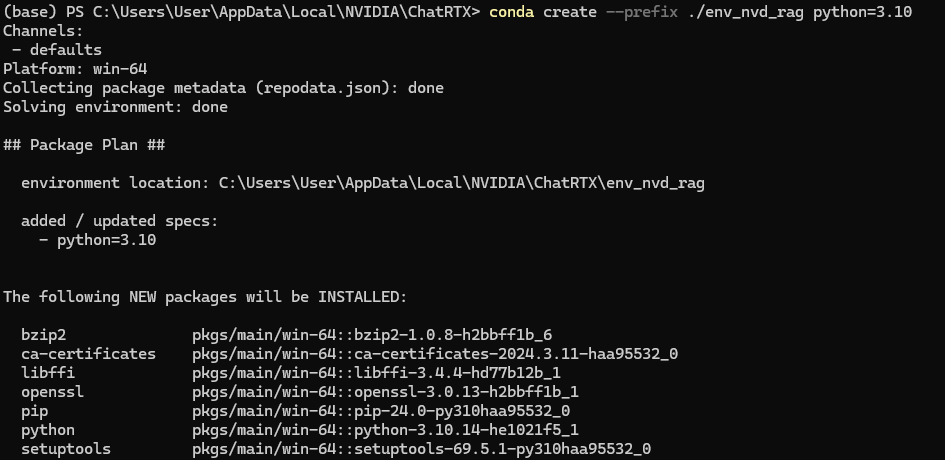

하지만 설치프로세스가 시작되고 조금 있으면, miniconda 관련 가상환경 생성실패 메시지가 뜹니다. 인터넷 검색결과 가상환경 수동생성을 통해 에러를 해결한 사례를 검색하여 적용결과 저도 설치에 성공할 수 있었습니다.

설치하고자 하는 디렉토리의 기본값을 변경하지 말고 해당 디렉토리에서 명령어 프롬프트를 실행한 후, 다음 화면과 같이 명령어를 복사하여 붙여 넣고 실행합니다.

conda create --prefix ./env_nvd_rag python=3.10

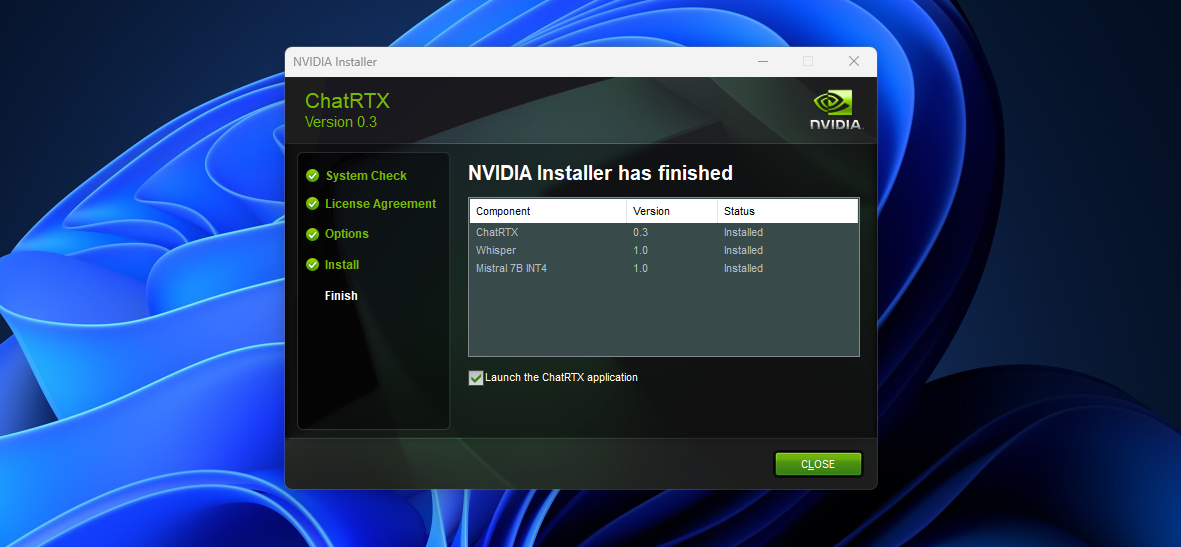

가상환경 생성이 완료되고 다시 설치 프로그램을 실행하면 약 15~20분 후 다음과 같이 설치가 완료됩니다.

ChatRTX 실행

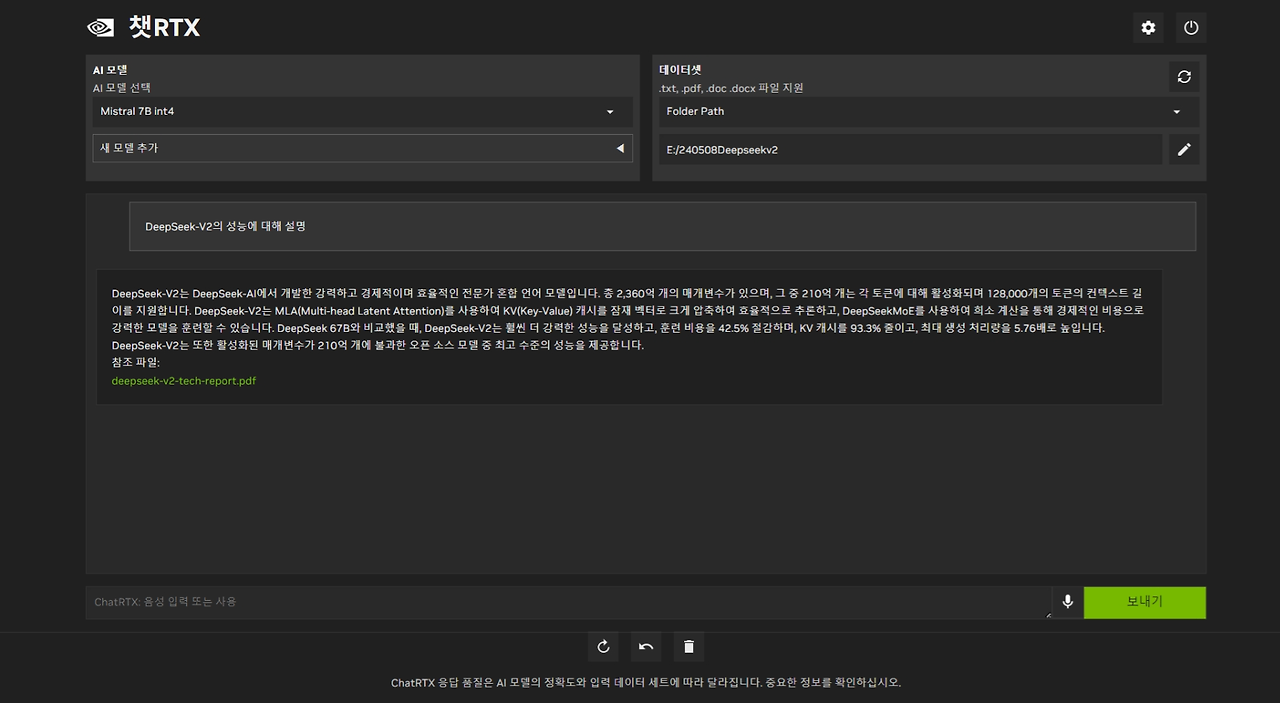

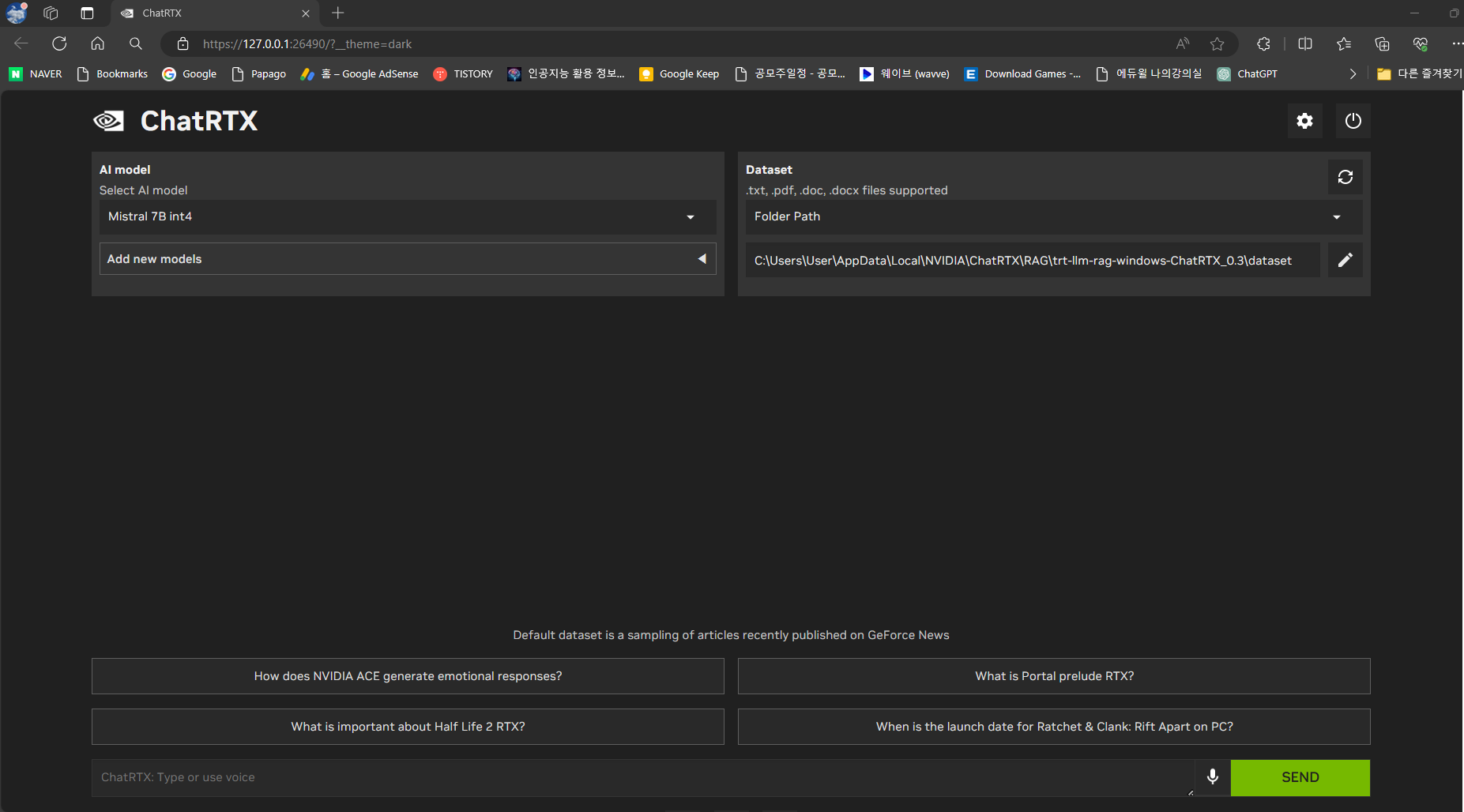

설치가 완료되고 바탕화면의 "ChatRTX" 아이콘을 실행하면 아래와 같이 초기화면이 로컬 주소 브라우저에서 열립니다.

초기화면 상단에는 AI 모델 선택 및 추가, 데이터 폴더 지정 및 AI 모델 기본대화를 선택할 수 있는 메뉴가 있습니다.

RAG 및 한국어 대화기능

먼저, RAG 기능을 테스트해 보았는데요, DeepSeek-V2 모델의 기술리포트 pdf 파일이 있는 디렉토리를 지정하고, 질문을 한 결과 아래와 같이 대답하였습니다. 실행속도는 Mistral 7B 언어 모델 로딩 속도는 20초 정도 소요되고, RAG 응답은 2~3초 정도 소요되었습니다. 참고로 제 컴퓨터 사양은 CPU는 인텔 i9-13900H이고, RAM은 16GB, 윈도우 11 Pro 23H2, GPU는 NVIDIA GeForce RTX 4060 8GB입니다.

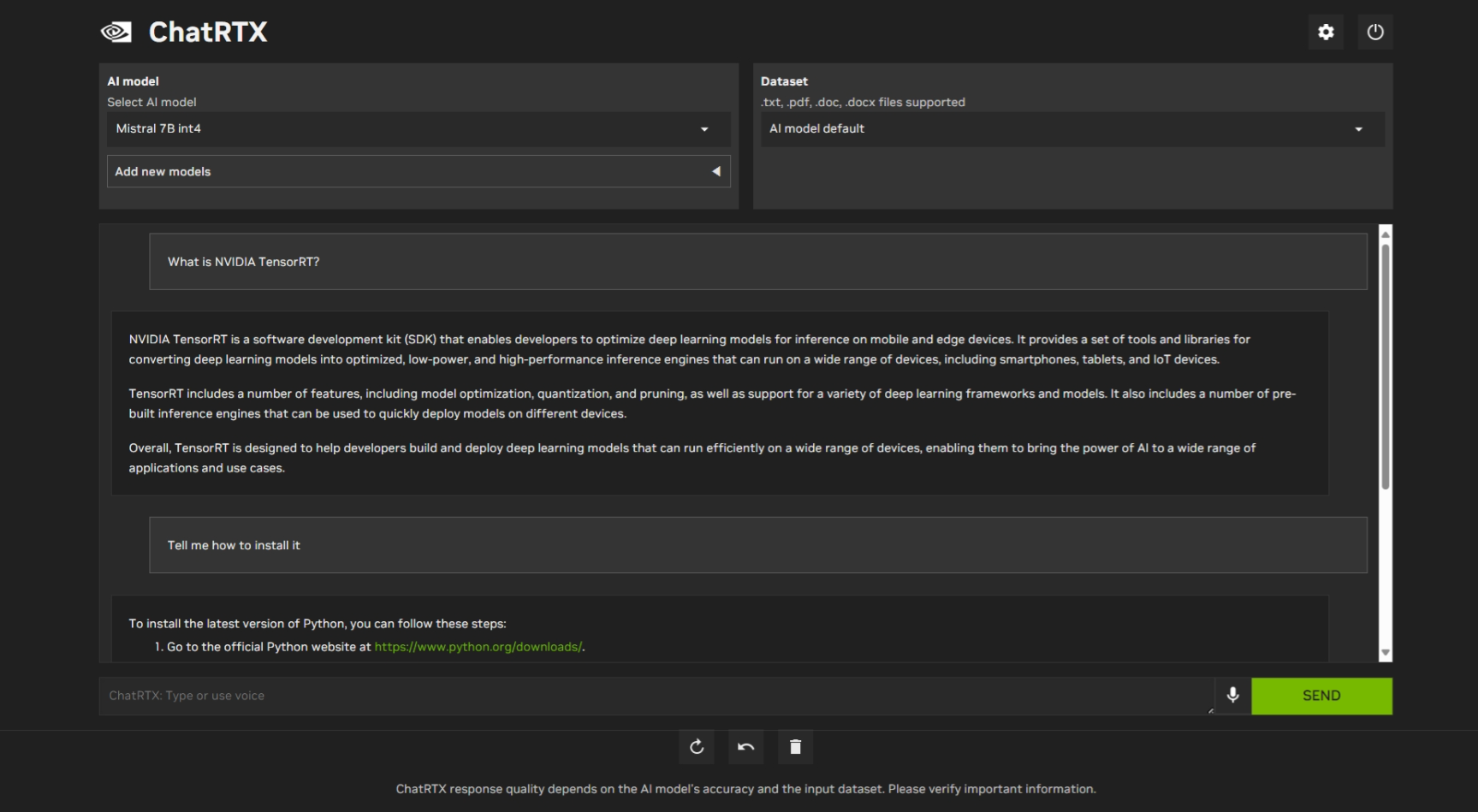

이번 업데이트에서도 이전 버전과 같이 RAG 응답에서 문맥을 이해하지 못하였습니다. 첫 번째 질문에 이어지는 두 번째 질문에서 중복 내용을 생략하면 ChatRTX는 이해하지 못합니다. 아래 화면을 보면 "What is NVIDIA TensorRT?"라는 질문에 이어지는 "Tell me how to install it"에는 전혀 다른 내용을 응답하고, "Tell me how to install NVIDIA TensorRT"라고 질문해야만 원하는 답변을 얻을 수 있습니다. 이 부분은 개선이 필요한 것 같습니다.

또한 이전 버전과 같이 Mistral 모델의 한계로 아래 화면과 같이 한국어 응답이 안 되는데요, 방법은 영어로 대화하고 브라우저의 번역기능을 사용하시는 방법이 있습니다.

이미지 검색기능

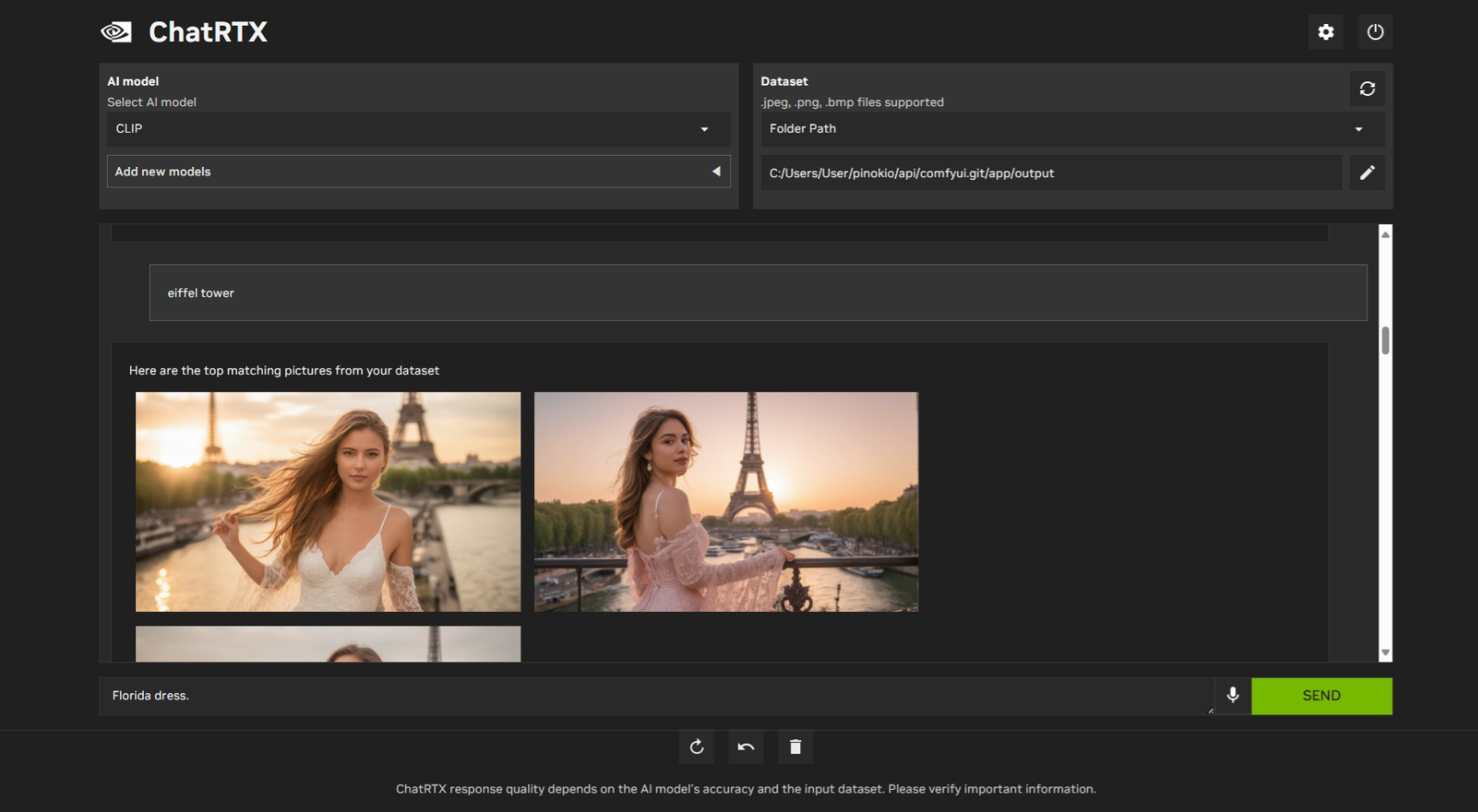

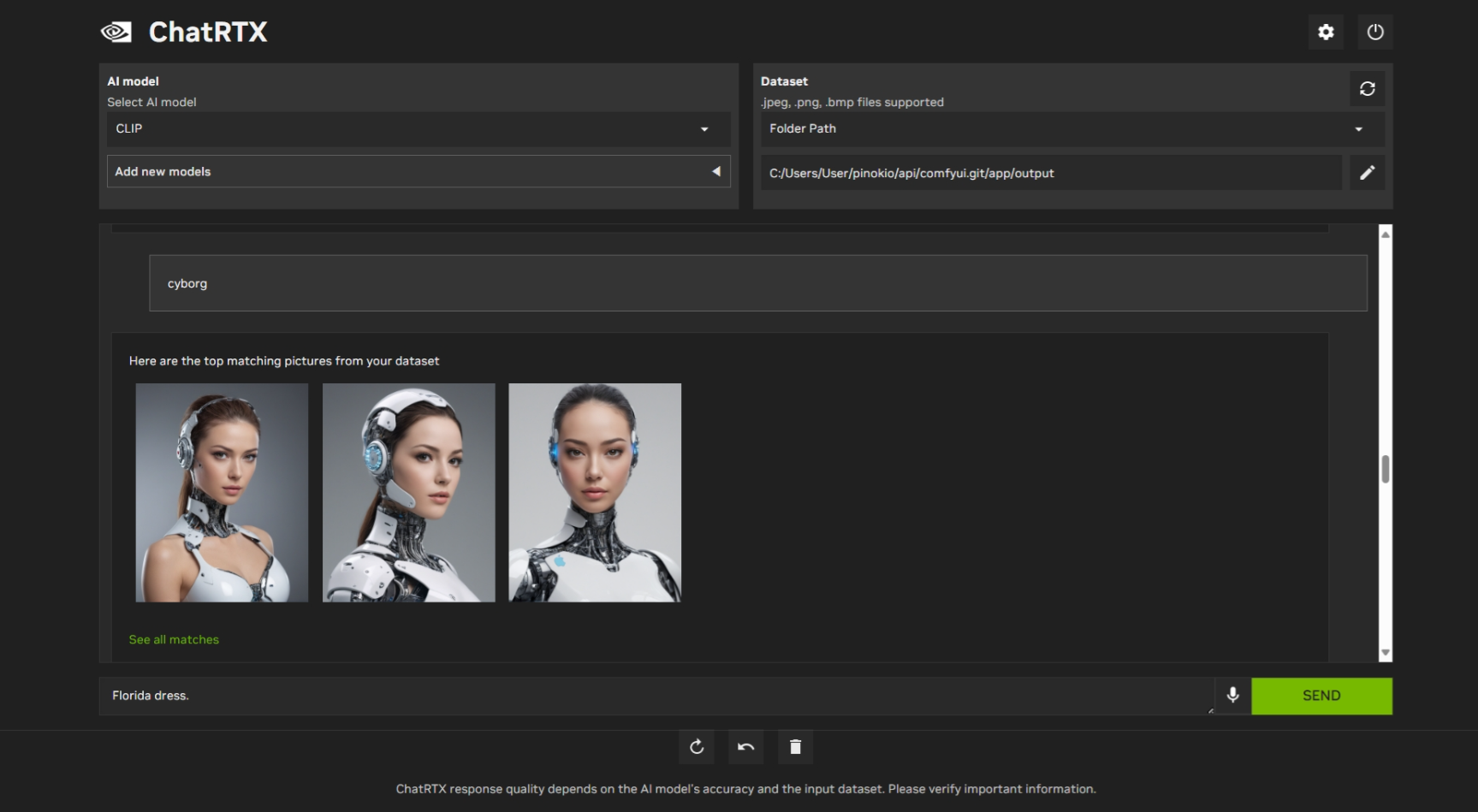

이번 업데이트에서 추가된 CLIP AI 모델을 활용한 이미지 검색기능을 테스트해 보려면, 먼저 AI 모델 추가메뉴에서 CLIP 모델을 다운로드하여야 합니다. 모델을 다운로드한 후, 상단 데이터셋 메뉴에서 이미지 파일이 있는 폴더 경로를 지정해 줍니다. 아래 화면은 제 컴퓨터의 이미지 파일이 저장된 폴더의 모습입니다.

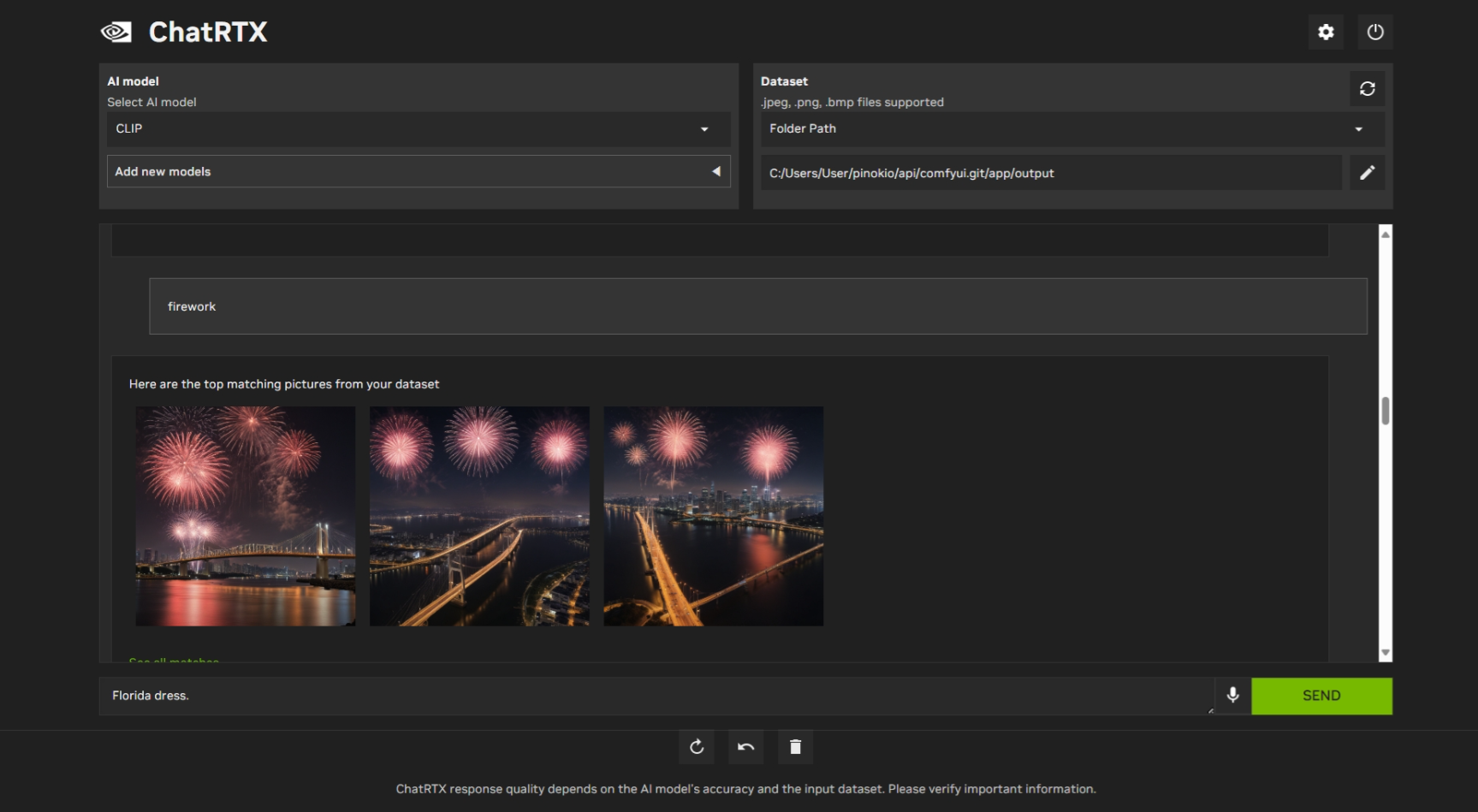

폴더 경로를 지정하고 프롬프트 입력창에 찾고 싶은 이미지의 내용이나 일부 단어를 입력하면 관련 이미지가 아래 화면과 같이 표시됩니다. 아래 화면은 "에펠탑"을 프롬프트에 입력한 결과로 정확하게 이미지를 검색해 주었습니다.

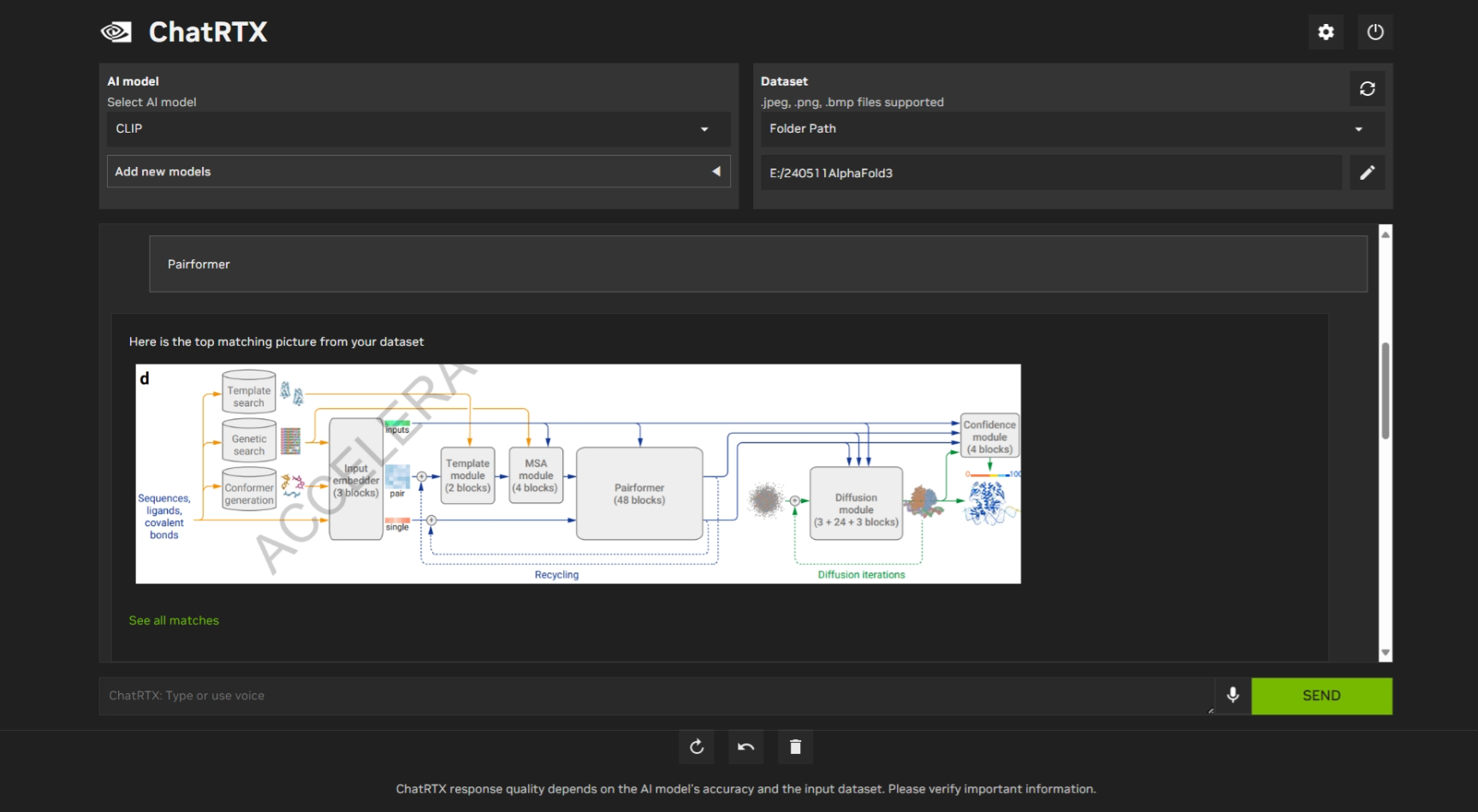

한 가지 흥미로운 점은 이미지 내 텍스트를 검색해도 해당 텍스트가 포함된 이미지를 검색할 수 있다는 것입니다. 아래 화면은 구글의 최신 AI 모델 알파폴드3 논문에 포함된 구성도이며, 모듈의 이름을 검색하면 이미지를 찾을 수 있었습니다.

맺음말

오늘 블로그에서는 사용자의 개인 파일 및 데이터에 연결된 대규모 언어 모델을 개인화하여 컨텍스트에 맞는 빠른 답변을 제공하는 데모 앱 NVIDIA ChatRTX의 최신 업데이트에 대해 알아보았습니다. 이번 업데이트에서는 이미지 인식이 가능한 CLIP 모델과 ChatGLM 모델이 추가되었으며, 다양한 파일을 지원하며 음성 인식과 사진 앨범 정리도 가능하며, 이전 버전에서 제공하던 YouTube URL 대화기능은 삭제되었습니다.

제가 사용해 본 결과 CLIP 모델의 이미지 검색기능과 이미지 내 텍스트 검색기능은 정확하고 신뢰할 수 있는 수준이었으며, 검색 증강 생성 (RAG) 기능은 다양한 파일을 지원하고 RTX 가속을 통한 빠른 응답속도가 장점이지만, 문맥 이해 부족과 한국어가 지원되지 않는 점은 개선이 필요한 것 같습니다. 자동 음성 인식 기능은 입출력 시간지연으로 자연스러운 대화는 어려운 수준입니다.

이 블로그가 ChatRTX를 설치하고 경험해 보고자 하는 분들에게 도움이 되기를 바라면서 저는 다음에 더 유익한 정보를 가지고 다시 찾아뵙겠습니다. 감사합니다.

2024.02.18 - [AI 도구] - 엔비디아의 최신 DEMO: Chat with RTX 설치 및 사용후기

엔비디아의 최신 DEMO: Chat with RTX 설치 및 사용후기

안녕하세요! 오늘은 최근 엔비디아에서 공개한 "Chat with RTX"의 설치 및 사용후기에 대해 작성해 보겠습니다. "Chat with RTX"는 사용자가 자신의 문서, 노트, 비디오 또는 기타 데이터에 연결된 GPT(Gene

fornewchallenge.tistory.com

'AI 도구' 카테고리의 다른 글

| Deepgram을 활용한 AI 음성 대화 시스템 구축 가이드 (0) | 2024.05.22 |

|---|---|

| Answer Engine: AI 검색엔진, 퍼플렉시티를 내 컴퓨터에서 무료로 돌리자! (Next.js, Ollama, Serper 활용 가이드) (0) | 2024.05.19 |

| Librechat: 온라인, 오프라인 AI 모델을 통합한 오픈소스 챗봇 플랫폼 (2) | 2024.05.15 |

| 엑셀과 대화: PandasAI와 Ollama활용 6줄 코드로 Llama3 챗봇 만들기 (0) | 2024.05.12 |

| LM Studio의 CLI를 활용한 EEVE 챗봇 만들기 (1) | 2024.05.10 |