인공지능(AI) 분야에 또 한 번의 '딥시크 모멘트(DeepSeek moment)'가 찾아왔습니다. 최근 공식 DeepSeek 계정에서 발표된 DeepSeek-V3.2는 AI 커뮤니티에 엄청난 충격을 안겨주었습니다. 이 모델은 단순히 강력한 성능을 보여주는 것을 넘어, 특정 영역에서 OpenAI나 Anthropic과 같은 폐쇄형 선두 연구소(closed source frontier labs)의 최고 모델들을 이겨냈으며, 심지어 훨씬 적은 예산과 놀라운 효율성으로 이를 달성했습니다.

DeepSeek-V3.2는 두 가지 버전으로 출시되었습니다: 일반적인 '사고 모델(regular thinking model)'인 V3.2와, 최대 성능을 위해 설계된 '맥스 사고 모델(max thinking model)'인 V3.2 스페셜입니다. 이 모델이 세상을 놀라게 한 가장 큰 이유는 바로 수학 경시대회에서의 성과입니다.

DeepSeek-V3.2는 국제 수학 올림피아드(International Math Olympiads, IMO)에서 금메달을 획득한 최초의 오픈 소스 모델이라는 공식 타이틀을 거머쥐었습니다.

이번 블로그 포스팅에서는 DeepSeek-V3.2의 충격적인 벤치마크 성능, 혁신적인 알고리즘적 돌파구, 그리고 AI의 미래인 에이전트(Agentic use) 사용에 최적화된 설계 방식에 대해 심층적으로 분석해 보겠습니다.

🏆 벤치마크 혁신: 오픈 소스 모델의 전례 없는 성과

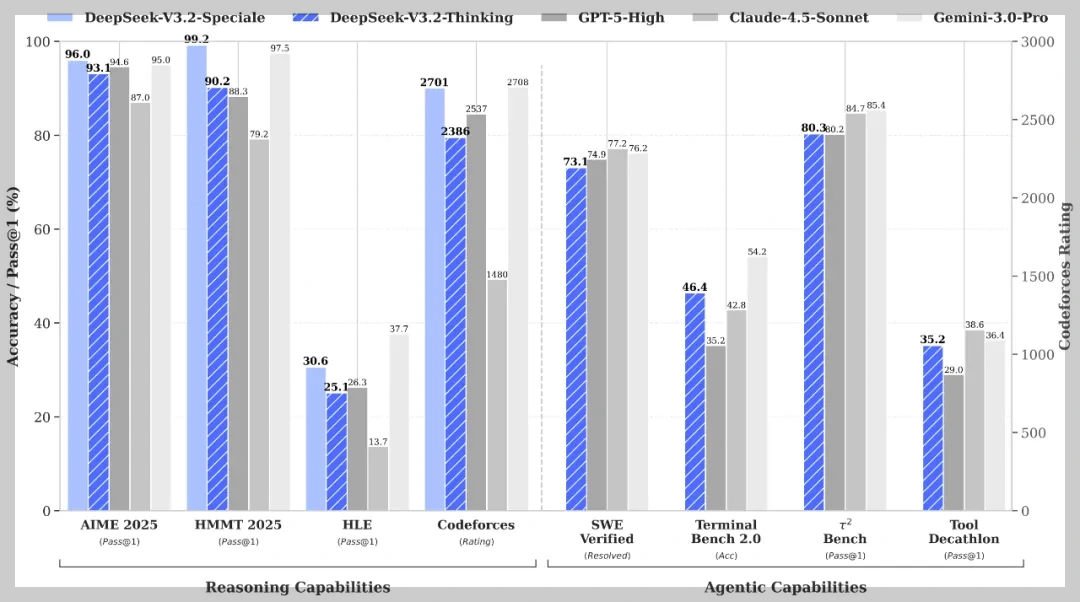

DeepSeek-V3.2는 세상을 놀라게 한 성능을 보여주었습니다. 특히 V3.2 Special은 주요 벤치마크에서 기존의 최고 모델들을 능가하는 모습을 보여주었습니다.

| 벤치마크 | GPT-5 High | Gemini 3.0 Pro | DeepSeek V3.2 Special |

|---|---|---|---|

| IMO 2025 | 94.6 | 95.0 | 96.0 |

| Live Codebench | 84.5 | - | 88.7 |

| GPQA Diamond | 85.7 | 91.9 | 85.7 |

IMO 2025 벤치마크에서 DeepSeek V3.2 Special은 96점을 기록하며 GPT-5 High의 94.6점과 Gemini 3.0 Pro의 95점을 뛰어넘었습니다. 또한, DeepSeek V3.2의 고성능 컴퓨팅 변형(3.2 special)은 GPT-5를 능가하며, Gemini 3.0 Pro와 대등한 추론 숙련도(reasoning proficiency)를 보였고, 2025 IMO와 IOI (International Olympiad in Informatics) 모두에서 금메달 성과를 달성했습니다.

토큰 효율성과 전략적 사용

DeepSeek은 성능 외적으로도 효율성을 고려했습니다.

- 일반 사고 모델(regular thinking model)은 GPT-5 High 및 Gemini 3.0 Pro와 비교했을 때 상당히 토큰 효율적입니다.

- 다만, 최고의 성능을 내는 스페셜 버전 모델은 엄청난 양의 토큰을 사용하며 토큰 효율성은 다소 떨어지지만, 그 대신 놀라운 점수를 기록했습니다. (예: Live Codebench에서 3.2 Special은 88.7점, 일반 모델은 83.3점).

참고: V3.2-Speciale은 복잡한 작업에서 압도적인 성능을 보이지만 더 높은 토큰 사용량이 필요합니다. 현재 커뮤니티 평가 및 연구를 위해 API로만 제공되며(도구 호출 미지원), 2025년 12월 15일까지 임시 엔드포인트로 제공됩니다.

🔬 DeepSeek의 세 가지 핵심 기술적 돌파구

DeepSeek은 모델 구축의 알고리즘 측면에서 경계를 확장하는 것으로 잘 알려져 있으며, 이번 모델에서는 두 가지 주요 기술적 돌파구를 포함한 총 세 가지 혁신을 도입했습니다.

DeepSeek Sparse Attention (DSA): 효율성의 혁명

첫 번째 주요 돌파구는 DeepSeek Sparse Attention (DSA)입니다. DeepSeek은 'Attention Is All You Need'의 핵심인 어텐션 메커니즘을 업데이트하여 놀라울 정도로 효율적으로 만들었습니다.

DSA는 장문(long context) 시나리오에서 모델 성능을 유지하면서 계산 복잡도를 실질적으로 감소시키는 효율적인 어텐션 메커니즘입니다.

- 배경: 지난 3년간의 모델 출시를 보면, 컨텍스트 윈도우(Context Window)가 크게 성장하지 못했다는 것을 알 수 있습니다. 이는 컨텍스트 윈도우를 늘리는 수학적 계산(compute cost)이 **2차 함수적(Quadratic, \(O(L^2)\))**으로 증가하기 때문입니다. 즉, 컨텍스트 윈도우를 늘리면 컴퓨팅 비용이 기하급수적으로 폭발하게 됩니다.

- DSA의 혁신: DSA는 이 문제를 해결합니다. 핵심 어텐션 복잡도(core attention complexity)를 \(O(L^2)\)에서 \(O(L \times K)\)로 줄였습니다.

- 의미: 가장 쉽게 이해하는 방법은 다음과 같습니다. 복잡도가 이 예시에서 기하급수적으로 확장되는 대신 더 선형적으로 확장된다는 것입니다. 이는 비용 폭발(exploding costs)과 통제된 비용(controlled costs)의 차이입니다.

이러한 어텐션 메커니즘의 효율성 향상은 속도를 희생하지 않고도 모델의 컨텍스트 윈도우를 늘릴 수 있게 해줍니다. 결론적으로, 이 모델은 운영 비용이 훨씬 저렴합니다.

확장 가능한 강화 학습(RL) 프레임워크에 대한 대규모 투자

두 번째는 확장 가능한 강화 학습(Scalable Reinforcement Learning) 프레임워크에 대한 투자입니다. DeepSeek은 강력한 강화 학습 프로토콜을 구현하고 학습 후 컴퓨팅(post-training compute)을 확장함으로써 v3.2를 GPT-5와 비교할 만한 성능으로 끌어올렸습니다.

DeepSeek은 사전 학습 비용(pre-training cost)의 10%를 초과하는 학습 후 컴퓨팅 예산(post-training computational budget)을 이 프레임워크에 할당했습니다. 이 10%라는 수치가 적게 들릴 수 있지만, 이전의 거의 모든 모델과 비교했을 때 상당히 많은 양입니다. 이 대규모의 RL 투자는 모델의 고급 기능을 해제하는 핵심 역할을 했습니다.

대규모 에이전트 작업 합성 파이프라인 구축

세 번째 주요 혁신은 대규모 에이전트 작업 합성 파이프라인(large-scale agentic task synthesis pipeline)입니다.

DeepSeek-V3.2는 에이전트 용도(agentic use)에 특화되어 있으며, 특히 **도구 호출(tool calling)**에 매우 뛰어납니다. DeepSeek은 이를 위해 인위적인 에이전트 데이터(synthetic agentic data)를 생성하도록 특별히 환경을 설정했습니다.

- DeepSeek은 추론을 도구 사용 시나리오에 통합하기 위해 대규모로 훈련 데이터를 체계적으로 생성하는 새로운 합성 파이프라인을 개발했습니다.

- 이들은 에이전트 작업을 위해 1,800개 이상의 구별되는 환경과 85,000개의 복잡한 프롬프트를 생성했습니다.

이러한 광범위한 합성 데이터는 RL 프로세스를 구동하며, 에이전트 컨텍스트에서 모델의 일반화 능력과 지침 준수 능력(instruction following capability)을 크게 향상시킵니다. AI 생성 프로세스에서 인간의 개입을 줄일수록 확장성이 더욱 높아진다는 점에서 이는 매우 혁신적인 접근 방식입니다.

🏗️ 모델 구조와 접근성: 오픈 소스의 희망

DeepSeek-V3.2는 성능은 최고 수준이지만 상대적으로 작은 규모인 6710억 개의 파라미터를 가진 모델입니다.

이 모델은 Mixture of Experts (MoE, 전문가 혼합) 모델이며, 추론(inference) 시에는 370억 개의 활성 파라미터를 사용합니다. 이는 막대한 규모의 LLM을 효율적으로 실행할 수 있게 해주는 구조입니다.

모델 실행을 위한 VRAM 요구 사항은 다음과 같습니다:

- FP8로 실행하려면 700 GB의 VRAM이 필요합니다.

- 전체 BF-16로 실행하려면 1.3 TB의 VRAM이 필요합니다.

가장 중요한 점은 DeepSeek-V3.2는 완전히 오픈 소스이며, **오픈 웨이트(open weights)**를 제공하고 MIT 라이선스를 따릅니다. 이는 누구나 이 최첨단 기술을 사용하고 검토하며 기반으로 구축할 수 있음을 의미합니다.

오픈 소스 릴리스:

- DeepSeek-V3.2 모델: Hugging Face

- DeepSeek-V3.2-Speciale 모델: Hugging Face

- 기술 보고서: PDF 다운로드

🤖 Thinking in Tool-Use: 에이전트의 시대

DeepSeek-V3.2는 도구 사용(tool use) 벤치마크에서 오픈 소스 LLM과 폐쇄형 LLM 간의 성능 격차를 상당히 좁혔습니다. 비록 선두 모델(Frontier models)보다는 여전히 낮지만, 매우 뛰어나고 근접한 수준을 유지하고 있습니다.

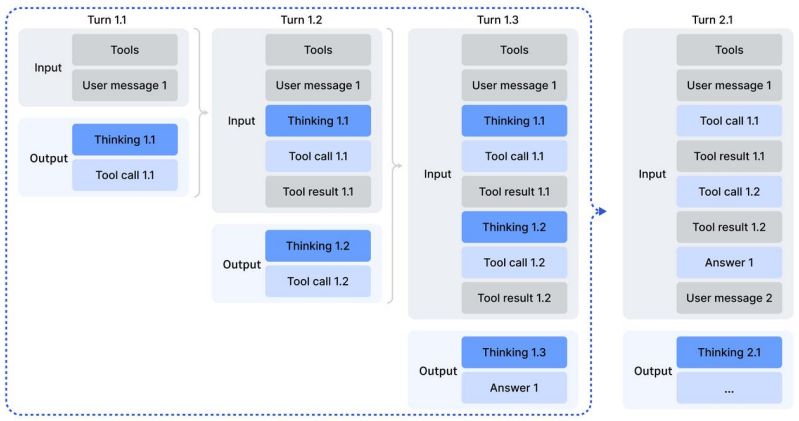

DeepSeek-V3.2는 우리의 첫 번째 모델로서 생각(thinking)을 도구 사용에 직접 통합했으며, 생각 모드와 비-생각 모드 모두에서 도구 사용을 지원합니다. 이는 모델이 에이전트 사용 사례에 뛰어나다는 점을 감안할 때, 미래 워크플로우에 필수적인 기능입니다.

생각 모드에서 도구 사용: DeepSeek-V3.2는 이제 생각(thinking) 프로세스 중에도 도구를 호출할 수 있어, 복잡한 문제 해결 과정에서 외부 리소스를 활용할 수 있습니다. 이는 모델의 추론 능력과 실제 세계와의 상호작용을 결합하여 더 강력한 에이전트 기능을 제공합니다.

💻 API 업데이트: 사용법 안내

DeepSeek-V3.2는 이제 앱, 웹 및 API를 통해 정식으로 사용할 수 있습니다. API 사용법은 다음과 같습니다:

V3.2 사용법

V3.2는 V3.2-Exp와 동일한 사용 패턴을 따릅니다. 기존 DeepSeek API를 사용하던 개발자라면 쉽게 전환할 수 있습니다.

DeepSeek-V3.2를 직접 테스트해볼 수 있는 실제 코드 예제입니다. 이 예제들을 통해 모델의 성능을 직접 경험해보세요:

Python 예제 (OpenAI SDK 사용):

# 먼저 OpenAI SDK 설치: pip install openai

import os

from openai import OpenAI

# DeepSeek API 설정

client = OpenAI(

api_key="sk-acebbf173cc34e6197f37acc805113af", # 실제 API 키로 교체 필요

base_url="https://api.deepseek.com"

)

# DeepSeek-V3.2로 채팅 완성 요청

response = client.chat.completions.create(

model="deepseek-chat", # V3.2 모델 사용

messages=[

{"role": "system", "content": "당신은 수학 문제 해결에 특화된 AI 어시스턴트입니다."},

{"role": "user", "content": "IMO 2025 문제 중 하나를 풀어주세요: \(x^3 + y^3 = 3xy\), \(x + y = 6\)일 때 x와 y의 값을 구하세요."},

],

stream=False

)

print(response.choices[0].message.content)cURL 예제:

curl https://api.deepseek.com/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer sk-acebbf173cc34e6197f37acc805113af" \

-d '{

"model": "deepseek-chat",

"messages": [

{"role": "system", "content": "당신은 수학 문제 해결에 특화된 AI 어시스턴트입니다."},

{"role": "user", "content": "IMO 2025 문제 중 하나를 풀어주세요: \(x^3 + y^3 = 3xy\), \(x + y = 6\)일 때 x와 y의 값을 구하세요."}

],

"stream": false

}'JavaScript/Node.js 예제:

// 먼저 OpenAI SDK 설치: npm install openai

import OpenAI from "openai";

const openai = new OpenAI({

baseURL: 'https://api.deepseek.com',

apiKey: 'sk-acebbf173cc34e6197f37acc805113af', // 실제 API 키로 교체 필요

});

async function testDeepSeek() {

const completion = await openai.chat.completions.create({

messages: [

{ role: "system", content: "당신은 수학 문제 해결에 특화된 AI 어시스턴트입니다." },

{ role: "user", content: "IMO 2025 문제 중 하나를 풀어주세요: \(x^3 + y^3 = 3xy\), \(x + y = 6\)일 때 x와 y의 값을 구하세요." }

],

model: "deepseek-chat", // V3.2 모델 사용

});

console.log(completion.choices[0].message.content);

}

testDeepSeek();Thinking Mode 사용법: DeepSeek-V3.2의 생각 모드를 활용하려면 공식 문서를 참고하세요. 생각 모드는 복잡한 문제 해결 과정을 단계별로 보여주므로 수학 문제나 논리적 추론이 필요한 작업에 특히 유용합니다.

V3.2-Speciale 사용법

V3.2-Speciale은 임시 엔드포인트를 통해 제공됩니다:

base_url = "https://api.deepseek.com/v3.2_speciale_expires_on_20251215"V3.2와 동일한 가격 정책을 따르지만, 도구 호출은 지원되지 않으며, 2025년 12월 15일 15:59 (UTC)까지 사용할 수 있습니다.

Thinking in Tool-Use 상세 정보: DeepSeek API 문서에서 자세한 내용을 확인할 수 있습니다.

💻DeepSeek-V3.2 수학 문제 해결 웹 데모

DeepSeek-V3.2의 놀라운 수학 문제 해결 능력을 직접 경험해볼 수 있는 웹 데모를 만들었습니다. 이 데모는 IMO 수학 문제를 실시간으로 해결하는 과정을 보여줍니다:

🧮 웹 데모 체험해보기: 아래 임베드된 데모에서 직접 테스트해보세요. \(x^3 + y^3 = 3xy\), \(x + y = 6\) 문제를 풀면서 DeepSeek-V3.2의 단계별 해결 과정을 확인할 수 있습니다.

문제: \(x^3 + y^3 = 3xy\), \(x + y = 6\)일 때 \(x\)와 \(y\)의 값을 구하세요.

이 문제는 DeepSeek-V3.2가 금메달을 획득한 IMO 2025의 유형 중 하나입니다.

* 실제 API 키를 입력해주세요. 데모 테스트용 키는 제공되지 않습니다.

이 웹 데모는 다음과 같은 특징을 가집니다:

- 실시간 API 연동: DeepSeek-V3.2 API와 직접 통신하여 실시간 응답

- LaTeX 수식 지원: MathJax 라이브러리로 복잡한 수학 공식을 웹에서 완벽하게 렌더링

- 단계별 해결 과정: DeepSeek-V3.2가 문제를 해결하는 추론 과정을 상세히 표시

- 반응형 디자인: 모바일과 PC 환경에서 모두 최적화된 사용자 경험

async function solveMathProblem() {

const apiKey = document.getElementById('apiKey').value;

const loadingDiv = document.getElementById('loading');

const resultDiv = document.getElementById('result');

// 로딩 표시

loadingDiv.style.display = 'block';

resultDiv.style.display = 'none';

try {

const response = await fetch('https://api.deepseek.com/chat/completions', {

method: 'POST',

headers: {

'Content-Type': 'application/json',

'Authorization': `Bearer ${apiKey}`

},

body: JSON.stringify({

model: 'deepseek-chat',

messages: [

{

role: 'system',

content: '당신은 IMO 금메달을 수상한 수학 전문가입니다. 수학 문제를 단계별로 명확하게 풀고, 각 단계의 수학적 원리를 설명해주세요.'

},

{

role: 'user',

content: '다음 연립방정식을 풀어주세요: \(x^3 + y^3 = 3xy\), \(x + y = 6\)일 때 x와 y의 값을 구하세요. 각 단계를 상세히 설명하고 최종 답을 명확히 제시해주세요.'

}

],

stream: true

})

});

const data = await response.json();

const solution = data.choices[0].message.content;

// 결과 표시

resultDiv.innerHTML = `DeepSeek-V3.2의 해결 과정:

`;

resultDiv.style.display = 'block';

// MathJax 렌더링

if (window.MathJax) {

MathJax.typesetPromise([resultDiv]).then(() => {

console.log('MathJax rendering complete');

});

}

} catch (error) {

resultDiv.innerHTML = `오류가 발생했습니다: ${error.message}

`;

resultDiv.style.display = 'block';

} finally {

// 로딩 숨기기

loadingDiv.style.display = 'none';

}

}

function formatSolution(solution) {

// 개행 문자를 HTML

태그로 변환

return solution.replace(/\n/g, '

');

}이 데모를 통해 독자들은 DeepSeek-V3.2의 실제 성능을 직접 경험하면서 오픈 소스 AI의 놀라운 가능성을 확인할 수 있습니다. 특히 수학 교육은 이 데모를 활용하여 학생들에게 더 나은 학습 경험을 제공할 수 있습니다.

🎯 결론: 효율성과 혁신의 승리

DeepSeek-V3.2의 출시는 오픈 소스 AI의 능력을 재정의하는 사건입니다. DSA를 통한 컴퓨팅 효율성 혁신, 전례 없는 RL 투자, 그리고 에이전트 중심의 데이터 합성 파이프라인은 DeepSeek이 적은 예산으로도 IMO 금메달이라는 성과를 달성하고 폐쇄형 모델과 경쟁할 수 있게 만든 원동력입니다. DeepSeek-V3.2는 단순한 성능 향상을 넘어, 미래의 AI 개발 비용 구조와 접근성을 근본적으로 변화시킬 잠재력을 보여줍니다.

여러분도 DeepSeek-V3.2의 오픈 소스 모델을 직접 다운로드하여 테스트해보시고, API를 통해 애플리케이션에 통합해보시길 추천드립니다. 저는 다음 시간에 더 새로운 AI 기술 동향을 가지고 돌아오겠습니다. 감사합니다.

'AI 언어 모델' 카테고리의 다른 글

| 🤖 CLaRa-7B-Instruct: 100쪽 책을 1쪽으로! Apple의 혁신적 AI 압축 기술 (0) | 2025.12.04 |

|---|---|

| 🚀 Mistral 3 출시: 무료 사용법 및 로컬 실행 가이드 (0) | 2025.12.03 |

| Kimi AI 멤버십 블랙프라이데이 특별 할인: 첫 달 $2.49, 4배 빠른 K2 Turbo 모델 (0) | 2025.12.02 |

| 🤖FLUX.2 출시: 4MP 해상도, 다중 참조 이미지 입력, 고급 텍스트 렌더링으로 무장한 이미지 생성 모델 (0) | 2025.11.26 |

| 🚀 Claude Opus 4.5 출시: 코딩, 에이전트, 컴퓨터 사용의 새로운 기준 (0) | 2025.11.25 |